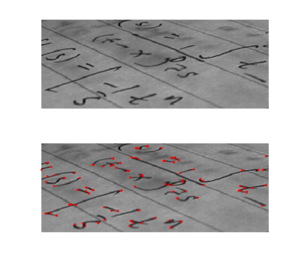

Результат типичного алгоритма обнаружения угла

Обнаружение угла - это подход, используемый в компьютерном зрении системы для извлечения определенных видов изображений и определения содержания. Обнаружение углов часто используется в обнаружении движения, изображения регистрации, слежении за видео, мозаике изображения, сшивании панорамы, 3D-реконструкция и распознавание объектов. Обнаружение углов перекликается с темой обнаружения точек интереса.

Содержание

- 1 Формализация

- 2 Алгоритм обнаружения углов Моравека

- 3 Алгоритмы обнаружения углов Харриса и Стивенса / Ши - Томази

- 4 Угловой детектор Ферстнера

- 5 Многомасштабный оператор Харриса

- 6 Метод кривизны кривой уровня

- 7 Лапласиан Гауссиана, разности гауссиана и определитель точек интереса в пространстве шкалы Гессе

- 8 Масштабные точки интереса на основе критериев силы признаков Линдеберга-Гессе

- 9 Аффинно-адаптированные операторы точек интереса

- 10 Алгоритм обнаружения углов Ванга и Брэди

- 11 Детектор углов SUSAN

- 12 Трайкович и Хедли Угловой детектор

- 13 Детекторы признаков на основе AST

- 14 Автоматический синтез детекторов

- 15 Детекторы пространственно-временных точек интереса

- 16 Библиография

- 17 Справочные реализации

- 18 См. также

- 19 Внешние ссылки

Формализация

Угол может быть определен как пересечение Использование двух ребер. Угол также можно определить как точку, для которой существуют два доминирующих и разных направления кромок в локальной окрестности точки.

Интересная точка - это точка на изображении, которая имеет четко определенное положение и может быть надежно обнаружена. Это означает, что точка интереса может быть, но она также может быть, например, изолированной точкой локального максимума или минимума интенсивности, окончанием линии или точкой на кривой, где кривизна локально максимальна.

На практике большинства так называемых методов обнаружения точек обнаружения в целом, фактически термины «угол» и «точка интереса» используются более или менее взаимозаменяемо в литературе. Как следствие, если должны быть обнаружены только углы, необходимо провести локальный анализ обнаруженных точек интереса, чтобы определить какие из них являются реальными углами. Примерами обнаружения краев, которые можно использовать с постобработкой для обнаружения, являются оператор Кирша и набор маскирования Фрей-Чена.

«Угол», «точка интереса» и «функция» "используются в литературе как синонимы, запутывая проблему. В частности, существует несколько детекторов больших двоичных объектов, которые можно назвать« операторами точки » интереса », но иногда ошибочно называют« детекторами углов ». Кроме того, существует понятие обнаружение гребня для обнаружения присутствия удлиненных объектов.

Угловые детекторы обычно не очень надежны и часто требуют больших избыточных возможностей,

Одним из факторов, определяющих качество детектора углов, его способность обнаруживать один и тот же угол на нескольких похожих изображениях в условиях разного освещения, перемещения, поворота и других преобразований.

Простым подходом к обнаружению углов в изображениях является использование корреляции, но это требует больших вычислительных затрат и неоптимально. ьзуемый альтернативный подход основан на методе, предложенном Харрисом и Стивенсом (ниже), который, в свою очередь, является улучшением метода Моравека.

Алгоритм обнаружения углов Моравец

Это один из самых ранних алгоритмов обнаружения углов, определяющий угол как точку с нижним самоподобием. Алгоритм проверяет каждый пиксель в изображении, чтобы увидеть, присутствует ли угол, насколько он похож на пиксель на соседние, в степени перекрывающиеся участки. Сходство измеряется как сумма квадратов разностей (SSD) между поставщиками двух участков. Меньшее число указывает на большее сходство.

Если пиксель находится в области одинаковой интенсивности, то соседние участки будут выглядеть одинаково. Если пиксель находится на краю, то следующие участки в направлении, перпендикулярном краю, будут выглядеть совершенно иначе, но соседние участки в направлении, параллельном краю, приведут только к небольшому изменению. Если пиксель находится на объекте с вариациями во всех направлениях, то ни один из ближайших участков не будет выглядеть одинаково.

Сила угла между определяется как наименьший SSD патчем и его соседями (горизонтально, вертикально и по двум диагоналям). Причина в том, что если это число велико, то вариация по всем сдвигам либо равна ему, либо больше, поэтому при захвате все соседние участки выглядят по-разному.

Если показатель прочности вычисляется для всех местоположений, то он локально максимален для одного местоположения, указывает, что в нем присутствует интересующий объект.

Как указывает Моравец, одна из основных проблем с этим оператором заключается в том, что он не изотропный : если присутствует край, который не находится в направлении соседей (горизонтальный, вертикальный или диагональный), тогда Самый маленький SSD будет большим, и край будет неправильно выбран в качестве точки интереса.

Алгоритмы определения углов Харриса и Стивенса / Ши-Томази

См. Харрис Угловой детектор.

Харрис и Стивенс усовершенствовали детектор углов Моравека, рассматривая разницу углов непосредственно по направлению вместо использования смещенных участков. (Эта угловая оценка часто используется как автокорреляция, поскольку этот термин используется в статье, которая описывает этот детектор. Однако математические данные в статье показывают, что используется сумма квадратов раз.)

ограничения общности мы будем предполагать, что используетсямерное изображение в градациях серого. Пусть это изображение будет задано как  . Возьмите фрагмент изображения в области

. Возьмите фрагмент изображения в области  и сместите его на

и сместите его на  . Взвешенная сумма квадратов разностей (SSD) между этими патчами, обозначенная

. Взвешенная сумма квадратов разностей (SSD) между этими патчами, обозначенная  , определяется как:

, определяется как:

может быть аппроксимировано разложением Тейлора. Пусть

может быть аппроксимировано разложением Тейлора. Пусть  и

и  будут частными производными из

будут частными производными из  , такое, что

, такое, что

Это дает приближение

может быть записан в матричной форме:

где A - тензор структуры ,

На словах мы находим ковариацию частной производной плотности изображения  по отношению к осям

по отношению к осям  и

и  .

.

Угловые скобки обозначают усреднение (то есть суммирование по  ).

).  обозначает тип окна, которое скользит по изображению. Если используется прямоугольный фильтр , ответ будет анизотропным, но если используется гауссовский, то ответ будет изотропным.

обозначает тип окна, которое скользит по изображению. Если используется прямоугольный фильтр , ответ будет анизотропным, но если используется гауссовский, то ответ будет изотропным.

угол (или вообще точка интереса) характеризуется большой изменением  во всех направлениях вектора

во всех направлениях вектора  . Анализируя собственные значения

. Анализируя собственные значения  , эту характеристику можно выразить следующим образом:

, эту характеристику можно выразить следующим образом:  должно иметь два "больших собственных значения для интересующей Основываясь на величинах собственных значений, на основании этого аргумента можно сделать следующие выводы:

должно иметь два "больших собственных значения для интересующей Основываясь на величинах собственных значений, на основании этого аргумента можно сделать следующие выводы:

- Если

и

и  , затем этот пиксель

, затем этот пиксель  не имеет интересных особенностей.

не имеет интересных особенностей. - Если

и

и  имеет большое положительное значение, тогда обнаружено ребро.

имеет большое положительное значение, тогда обнаружено ребро. - Если

и

и

имеют большие положительные значения, тогда обнаруживается угол.

имеют большие положительные значения, тогда обнаруживается угол.

Харрис и Стивенс отмечают, что точное вычисление собственных значений вычислительно затратно, так как требует вычисления квадратного корня и вместо этого предлагает свою функцию функцию  , где

, где  - настраиваемый параметр чувствительности eter:

- настраиваемый параметр чувствительности eter:

Следовательно, алгоритму не нужно фактически вычислять разложение по собственным значениям <матрицы 152>A {\ displaystyle A} , а вместо этого достаточно для оценки детерминанта и трассы для

, а вместо этого достаточно для оценки детерминанта и трассы для  , чтобы найти углы или, скорее, точки интереса в целом.

, чтобы найти углы или, скорее, точки интереса в целом.

Угловой детектор Ши - Томази напрямую вычисляет  потому что при предположениях углы более устойчивые для установки. Обратите внимание, что этот метод также иногда называют угловым детектором Канаде - Томази.

потому что при предположениях углы более устойчивые для установки. Обратите внимание, что этот метод также иногда называют угловым детектором Канаде - Томази.

Значение  должно быть определено эмпирически, и в литературе значения в диапазоне 0,04–0,15 указаны как возможные.

должно быть определено эмпирически, и в литературе значения в диапазоне 0,04–0,15 указаны как возможные.

Можно избежать установки параметра  , используя угловую меру Нобла

, используя угловую меру Нобла  , что составляет среднее гармоническое собственных значений:

, что составляет среднее гармоническое собственных значений:

является небольшим положительным постоянным.

является небольшим положительным постоянным.

Если  можно интерпретировать как матрицу точности для положения угла, ковариационная матрица для положения угла:

можно интерпретировать как матрицу точности для положения угла, ковариационная матрица для положения угла:  , т.е.

, т.е.

Сумма собственных значений  , которая в этом может быть интерпретирована как обобщенная дисперсия (или «общая неопределенность») углового положения, связано с угловой мерой Нобла

, которая в этом может быть интерпретирована как обобщенная дисперсия (или «общая неопределенность») углового положения, связано с угловой мерой Нобла  по следующему уравнению:

по следующему уравнению:

Детектор углового

Определение углов с использованием алгоритма Ферстнера

В некоторых случаях можно вычислить положение угла с субпиксельной точностью. Чтобы достичь приближенного решения, алгоритм Ферстнера находит точку, ближайшую ко всем касательным линии угла в данном окне, и представляет собой решение по методу наименьших квадратов. Алгоритм основан на том факте, что для идеального угла касательной линии пересекаются в одной точке точки.

Уравнение касательной  в пикселе

в пикселе  определяется по формуле:

определяется по формуле:

где ![\nabla I(\mathbf{x'})=[I_{\mathbf{x}},I_{\mathbf{y}}]^{\top}](https://wikimedia.org/api/rest_v1/media/math/render/svg/081d215e2f446da3883f43806705cbdb037db1b4) - вектор градиента изображения

- вектор градиента изображения  в

в  .

.

Точка  ближайшая ко всем касательным линиям в окне

ближайшая ко всем касательным линиям в окне  :

:

Расстояние от  до касательных линий

до касательных линий  взвешивается по величине градиента, что придает большее значение касательным, проходящим через пиксели с сильными градиентами.

взвешивается по величине градиента, что придает большее значение касательным, проходящим через пиксели с сильными градиентами.

Решение относительно  :

:

определяет как:

определяет как:

Минимизация этого уравнения может быть выполнена путем дифференцирования по  и установив его равным 0:

и установив его равным 0:

Обратите внимание, что  - это структурный тензор. Чтобы уравнение имело решение,

- это структурный тензор. Чтобы уравнение имело решение,  должен быть обратимым, что означает, что

должен быть обратимым, что означает, что  должен иметь полный ранг (ранг 2). Таким образом, решение

должен иметь полный ранг (ранг 2). Таким образом, решение

существует только в том случае, если фактический угол существует в окне  .

.

Линдеберг представил методологию автоматического выбора масштаба для этого метода угловой локализации путем минимизации нормализованной невязки

в масштабе. Таким образом, способ позволяет автоматически адаптировать уровни шкалы для вычислений градиентов изображения к уровню шума в данных изображения, выбирая более высокие уровни шкалы для зашумленных данных изображения и более тонкие уровни шкалы для почти идеальных угловидных структур.

Примечания:

можно рассматривать как остаток при вычислении решения методом наименьших квадратов: if

можно рассматривать как остаток при вычислении решения методом наименьших квадратов: if  , то ошибки не было.

, то ошибки не было.- этот алгоритм можно модифицировать для вычислений круговых объектов, заменив касательные на нормальные.

Мультимасштабный оператор Харриса

Вычисление второй матрицы моментов (иногда также называемой тензором структуры )  в операторе Харриса требует вычислений из производных изображений

в операторе Харриса требует вычислений из производных изображений  в области изображения, а также суммирование нелинейных комбинаций этих производных по локальным изменениям. Временное вычисление производных обычно включает этапы сглаживания масштабного пространства для рабочего определения оператора Харриса требуются два масштабных проекта: (i) локальный масштаб для сглаживания перед вычислением производных изображений, (ii) шкала интеграции для накопления нелинейных операций над производными операторами в интегрированном дескрипторе изображения.

в области изображения, а также суммирование нелинейных комбинаций этих производных по локальным изменениям. Временное вычисление производных обычно включает этапы сглаживания масштабного пространства для рабочего определения оператора Харриса требуются два масштабных проекта: (i) локальный масштаб для сглаживания перед вычислением производных изображений, (ii) шкала интеграции для накопления нелинейных операций над производными операторами в интегрированном дескрипторе изображения.

Если  обозначает яркость исходного изображения, пусть

обозначает яркость исходного изображения, пусть  обозначает масштаб пространственное представление из

обозначает масштаб пространственное представление из  , полученное сверткой с гауссовым ядром

, полученное сверткой с гауссовым ядром

с параметром локального масштаба  :

:

и пусть  и

и  обозначают частные производные от

обозначают частные производные от  . Кроме того, введите гауссову оконную функцию

. Кроме того, введите гауссову оконную функцию  с параметром масштаба интегрирования

с параметром масштаба интегрирования  . Тогда многомасштабная матрица второго момента может быть определена как

. Тогда многомасштабная матрица второго момента может быть определена как

Затем мы можем вычислить собственные значения  таким же образом, как собственные значения

таким же образом, как собственные значения  и определить multi - масштабная угловая мера Харриса как

и определить multi - масштабная угловая мера Харриса как

.

.

Относительно выбора местного масштаба  и параметра масштаба интегрирования

и параметра масштаба интегрирования  , эти параметры масштаба обычно связаны с параметром относительного интегрированного масштаба

, эти параметры масштаба обычно связаны с параметром относительного интегрированного масштаба  такой, что

такой, что  , где

, где  обычно выбирается в интервале

обычно выбирается в интервале ![[1, 2]](https://wikimedia.org/api/rest_v1/media/math/render/svg/f2614991ef363710c34e03eb9110d7423e3f60c2) . Таким образом, мы можем вычислить многомасштабную угловую меруриса

. Таким образом, мы можем вычислить многомасштабную угловую меруриса  в любом масштабе

в любом масштабе  в масштабном пространстве, чтобы получить многомасштабный детектор углов, который реагирует на угловые структуры различных размеров в области изображения.

в масштабном пространстве, чтобы получить многомасштабный детектор углов, который реагирует на угловые структуры различных размеров в области изображения.

На практике многомасштабный детектор углов часто дополняется этапом выбора шкалы, где нормированный по шкале лапласовский оператор

вычисляются в каждом масштабе в пространстве- масштабе и адаптированные масштабу угловые точки с автоматическим масштабом («оператор Харриса-Лапласа») вычисляются из точек, которые одновременно действуют:

- пространственными максимумами многомасштабной угловой меры

- локальные максимумы или минимумы по шкалам нормированного по мас штабу оператора лапласа

:

:

Метод кривизны кривой уровня

Более ранний подход к обнаружению углов заключался в обнаружении точек, в кривизна кривых уровня и величины градиента одновременно велики. Дифференциальный способ обнаружения точек состоит в вычислении измененной кривой уровня (произведение кривизны кривой уровня и уровня градиента, возведенной в степени трех)

и для обнаружения положительных максимумов и отрицательных минимумов этого дифференциального выражения в некотором масштабе  в представлении пространства масштаба

в представлении пространства масштаба  исходного изображения. Однако основная проблема при вычислении объекта кривизны измененной кривой уровня в едином масштабе заключается в том, что он может быть чувствителен к шуму и к выбору уровня шкалы. Лучшим методом является вычисление

исходного изображения. Однако основная проблема при вычислении объекта кривизны измененной кривой уровня в едином масштабе заключается в том, что он может быть чувствителен к шуму и к выбору уровня шкалы. Лучшим методом является вычисление  -нормализованной кривизны измененной кривой уровня

-нормализованной кривизны измененной кривой уровня

с  и для обнаружения знаков экстремумов масштабного пространства этого выражения, то есть точки и масштабов, которые являются положительными максимумами и отрицательными минимумами по отношению к пространству и масштабам

и для обнаружения знаков экстремумов масштабного пространства этого выражения, то есть точки и масштабов, которые являются положительными максимумами и отрицательными минимумами по отношению к пространству и масштабам

в сочетании с дополнительным шагом локализации для обработки увеличения ошибки локализации в более грубых масштабах. Таким образом, большие значения масштаба связаны с закругленными углами с небольшой пространственной протяженностью. Этот подход является первым детектором углового с автоматическим выбором масштаба (до «оператора Харриса-Лапласа» выше) и использовался для установки углов при крупномасштабных вариациях в области изображения и для сопоставления угловых характеристик с краями для вычисления структурных характеристик изображения. для распознавания объектов на основе geon.

лапласиан гауссиана, различия гауссиана и детерминант гессианских точек интереса в масштабном пространстве

LoG - это аббревиатура от слова лапласиана гауссиана, DoG - это аббревиатура, обозначающая разница гауссианов (DoG - это приближение к LoG), а DoH - это аббревиатура, обозначающая определитель гессиана. Все эти масштабно-инвариантные точки интереса извлекаются обнаружение экстремумов в масштабном измерении нормализованных по показателям измерений, т. Е. Точек в пространственных масштабах, где соответствующие различия выражения, нормализованные по масштабу, предполагают локальные экстремумы как по пространству, так и по масштабу

где  обозначает соответствующую нормированную по масштабам отличительную сущность (определенную ниже).

обозначает соответствующую нормированную по масштабам отличительную сущность (определенную ниже).

Эти детекторы более полно возможностей в обнаружении blob. Нормированный по масштабу лапласиан гауссовских и разностных гауссовских характеристик (Lindeberg 1994, 1998; Lowe 2004)

не очень высокоселективные функции, поскольку эти операторы могут также приводить к откликам вблизи краев. Чтобы способность улучшить обнаружение обнаружий детектора Гауссиана, детектор признаков, использованных в системе SIFT, использует дополнительный этап постобработки, где собственные значения элемента Гессиан изображения в масштабе обнаружения исследуются аналогично оператору Харриса. Такое изображение слишком похоже на кромку, когда имеется соотношение значений велико. Также можно определить лапласиан Линдеберга детектора гауссовских признаков, включающий дополнительный пороговую обработку для дополнительного дифференциального инварианта для подавления откликов вблизи краев.

Нормализованный по шкале определитель оператора Гессе (Lindeberg 1994, 1998)

, с другой стороны, очень избирательно относится к хорошо локализованным функциям изображения и реагирует только тогда, когда есть значительные вариации уровня серого в двух направлениях изображения, и в этом и других отношениях является лучшим детектором точки интереса. чем лапласиан гауссиана. Определитель гессиана является аффинно-ковариантным отличительным выражением и имеет лучшие свойства выбора масштаба при преобразованиях аффинных изображений, чем оператор Лапласа (Lindeberg 2013, 2015). Экспериментально это означает, что определитель точки интереса Гессе имеет лучшие свойства эффективности при использовании Лапласа, что, в свою очередь, приводит к лучшей производительности сопоставления на основе изображений с точки зрения более высокой эффективности и более низких показателей точности 1

Свойства выбора шкалы, свойства аффинного преобразования и экспериментальные свойства этих и других детекторов интереса в масштабном пространстве подробно проанализированы в (Lindeberg 2013, 2015).

Точки интереса в пространстве на основе Измерение силы элементов Линдеберга по Гессе

На основе структурно-свойств матрицы Гессе  функции

функции  и матрица второго момента (тензор структуры)

и матрица второго момента (тензор структуры)  , например, проявляться в терминах аналогичных свойств преобразования при деформации аффинного изображения

, например, проявляться в терминах аналогичных свойств преобразования при деформации аффинного изображения

,

, ,

,

Линдеберг (2013, 2015) великолепно определить четыре меры силы матрицы из структурного тензора (матрицы момента), как операторы Харриса и Ши-и-Томази из структурного тензора. В частности, он определил следующие беззнаковые и подписанные меры силы гессенских признаков:

- беззнаковые меры силы гессенских признаков I:

- мера силы гессенских признаков со знаком I:

- беззнаковая мера силы гессенской характеристики II:

- знаковая мера силы гессенской характеристики II:

где  и

и  обозначают след и определитель Матрица Гессе

обозначают след и определитель Матрица Гессе  представления пространства масштаба

представления пространства масштаба  в любом масштабе

в любом масштабе  , тогда как

, тогда как

обозначают собственные значения матрицы Гессе.

Беззнаковая сила признака Гессе мера  реагирует на локальные экстремумы положительными значениями и нечувствителен к седловым точкам, тогда как знаковый показатель силы гессенских признаков

реагирует на локальные экстремумы положительными значениями и нечувствителен к седловым точкам, тогда как знаковый показатель силы гессенских признаков  дополнительно реагирует на седловые точки отрицательными значениями. Беззнаковая мера силы гессенской характеристики

дополнительно реагирует на седловые точки отрицательными значениями. Беззнаковая мера силы гессенской характеристики  нечувствительна к локальной полярности сигнала, тогда как знаковая мера силы гессенской характеристики

нечувствительна к локальной полярности сигнала, тогда как знаковая мера силы гессенской характеристики  реагирует на локальную полярность сигнала знаком его выхода.

реагирует на локальную полярность сигнала знаком его выхода.

В Lindeberg (2015) эти четыре дифференциальных объекта были объединены с выбором локального масштаба на основе обнаружения экстремумов в пространстве масштаба

или масштабное связывание. Кроме того, сила гессенских признаков со знаком и без знака измеряет  и

и  были объединены с дополнительным пороговым значением для

были объединены с дополнительным пороговым значением для  .

.

Путем экспериментов по сопоставлению изображений при преобразованиях масштабирования на наборе данных плаката с 12 плакатами с согласованием нескольких ракурсов по преобразованиям масштабирования с коэффициентом масштабирования до 6 и вариациями направления обзора до угла наклона 45 градусов с локальными дескрипторами изображения определяется из переформулировок дескрипторов чистого изображения в операторах SIFT и SURF для измерения изображений в терминах операторов производной Гаусса (Gauss-SIFT и Gauss-SURF) вместо исходного SIFT, как определено из пирамиды изображения или пер в первоначальном SURF, как определено из вейвлетов Хаара, было показано масштабирование обнаружения точки интереса в пространстве на основе беззнакового показателя силы признаков Гессе  позволяет обеспечить лучшую производительность и лучшую производительность, чем интерес в масштабе пространства, полученный из определителя гессиана

позволяет обеспечить лучшую производительность и лучшую производительность, чем интерес в масштабе пространства, полученный из определителя гессиана  . И беззнаковый показатель прочности гессенского элемента

. И беззнаковый показатель прочности гессенского элемента  , знаковый показатель прочности гессенского элемента

, знаковый показатель прочности гессенского элемента  и определитель гессиана

и определитель гессиана  допускает лучшую производительность, чем лапласиан гауссовского

допускает лучшую производительность, чем лапласиан гауссовского  . В сочетании с привязкой шкалы и дополнительным пороговым значением для

. В сочетании с привязкой шкалы и дополнительным пороговым значением для  , подписанный показатель силы гессенских элементов

, подписанный показатель силы гессенских элементов  показал лучшую характеристику, чем лапласиан гауссовского

показал лучшую характеристику, чем лапласиан гауссовского  .

.

Кроме того, было показано, что все эти показатели на основе Матрица Гессе показывают, что все эти показатели на основе Матрица Гессе позволяют показать большее количество точек интереса и лучшее сопоставление по сравнению с оператором Харма и Ши-и-Томази. 403>

Теоретический анализ свойств выбора шкалы этих четырех мер силы признаков Гессе и других отличий х объектов для обнаружения в масштабах е, включая определение гессиана, приведен в Lindeberg. (2013) и анализ их свойств аффинного преобразования, а также экспериментальных свойств в Lindeberg (2015).

Аффинно-адаптированные операторы точки интереса

Точки интереса, полученные из многомасштабного метода Харриса с автоматическим выбором масштаба инвариантны к сдвигам, поворотам и равномерным масштабам в пространственной области. Однако изображения, входящие в систему компьютерного зрения, также подвержены перспективным искажениям. Чтобы получить оператор точки интереса, который более устойчивым к перспективным преобразованиям, естественным подходом является разработка детектора признаков, который инвариантен к аффинным преобразованиям. На практике аффинно-инвариантные точки интереса могут быть получены путем применения изображения адаптации аффинной формы, где форма сглаживающего ядра итеративно деформируется, чтобы соответствовать локальному фрагменту вокруг точки интереса, или, что эквивалентно, локальный фрагмент итеративно деформируется в то время как форма сглаживающего ядра остается вращательно-симметричной (Lindeberg 1993, 2008; Lindeberg and Garding 1997; Mikolajzcyk and Schmid 2004). Следовательно, помимо обычно используемого многомасштабного оператора Харриса, адаптация аффинной формы может быть применена к другим детекторам углов, перечисленным в этой статье, а также к дифференциальным детекторам капель, таким как лапласиан / разность гауссовского оператора, оператора Гессе - Лапласа.

Алгоритм обнаружения углов Ванга и Брэди

Детектор Ванга и Брейди рассматривает изображение как поверхность и ищет места с большой кривизной вдоль изображения край. Другими словами, алгоритм ищет места, где край быстро меняет направление. Оценка угла,  , определяется по формуле

, определяется по формуле

где  - единичный вектор, перпендикулярный градиенту, а

- единичный вектор, перпендикулярный градиенту, а  определить степень фобии кромок у детектора. Авторы также отмечают, что для уменьшения шума требуется сглаживание (предлагается гауссово).

определить степень фобии кромок у детектора. Авторы также отмечают, что для уменьшения шума требуется сглаживание (предлагается гауссово).

Сглаживание также вызывает смещение углов, поэтому используются его в поправке коэффициента к углам угла 90 градусов.

Угловой детектор SUSAN

SUSAN - это аббревиатура, обозначающая наименьшее ядро, ассимилирующее однозначный сегмент. Этот метод является предметом патента Великобритании 1994 года, который больше не действует.

Для обнаружения SUSAN помещает круг маску на пиксель, который нужно проверить (ядро). Область маски:  , пиксель в этой маске представлен как

, пиксель в этой маске представлен как  . Ядро находится в

. Ядро находится в  . Каждый пиксель сравнивается с ядром с помощью функций сравнения:

. Каждый пиксель сравнивается с ядром с помощью функций сравнения:

где  - порог разницы яркости,

- порог разницы яркости,  - яркость пикселя и степень экспоненты была определена эмпирически. Эта функция имеет вид сглаженной функции в виде цилиндра или прямоугольной функции. Площадь SUSAN определяется следующим образом:

- яркость пикселя и степень экспоненты была определена эмпирически. Эта функция имеет вид сглаженной функции в виде цилиндра или прямоугольной функции. Площадь SUSAN определяется следующим образом:

Если  - прямоугольная функция, то

- прямоугольная функция, то  - количество пикселей в маске, которые находятся в пределах

- количество пикселей в маске, которые находятся в пределах  ядра. Ответ оператора SUSAN определяется следующим образом:

ядра. Ответ оператора SUSAN определяется следующим образом:

, где  равно назвал " геометрический порог ". Другими словами, оператор SUSAN получает положительную оценку только в том случае, если область достаточно мала. Наименьший локальный SUSAN можно найти с помощью немаксимального подавления, и это полный оператор SUSAN.

равно назвал " геометрический порог ". Другими словами, оператор SUSAN получает положительную оценку только в том случае, если область достаточно мала. Наименьший локальный SUSAN можно найти с помощью немаксимального подавления, и это полный оператор SUSAN.

Значение  определяет, насколько похожими должны быть точки для ядра, прежде чем они будут считаться частью однозначного сегмента. Значение

определяет, насколько похожими должны быть точки для ядра, прежде чем они будут считаться частью однозначного сегмента. Значение  определяет минимальный размер однозначного сегмента. Если

определяет минимальный размер однозначного сегмента. Если  достаточно, тогда это становится велик детектором края.

достаточно, тогда это становится велик детектором края.

Для определения угла используются два следующих шага. Во-первых, центроид SUSAN находится. В правом углу центра тяжести находится далеко от ядра. Второй шаг настаивает на том, чтобы все точки на линии от ядра находились через центроид до края маски находились в SUSAN.

Детектор углов Трайковича и Хедли

Подобно SUSAN, этот детектор непосредственно проверяет, является ли участок под пикселем самоподобным, исследуя соседние пиксели.  - рассматриваемый пиксель, а

- рассматриваемый пиксель, а  - точка на окружности

- точка на окружности  с центром вокруг

с центром вокруг  . Точка

. Точка  - это точка, противоположная

- это точка, противоположная  по диаметру.

по диаметру.

Функция отклика определяется как:

Это будет большим, если нет направления, в котором центральный пиксель похож на два соседних пикселя по диаметру.  - это дискретный круг (круг Брезенхема ), поэтому интерполяция используется для промежуточных диаметров, чтобы дать более изотропный ответ. Любое вычисление дает верхнюю границу

- это дискретный круг (круг Брезенхема ), поэтому интерполяция используется для промежуточных диаметров, чтобы дать более изотропный ответ. Любое вычисление дает верхнюю границу  , сначала проверяется горизонтальное и вертикальное направления, чтобы увидеть, стоит ли продолжать полное вычисление

, сначала проверяется горизонтальное и вертикальное направления, чтобы увидеть, стоит ли продолжать полное вычисление  .

.

Детекторы функций на основе AST

AST - это аббревиатура, обозначающий ускоренный сегментный тест. Этот тест представляет собой упрощенную версию критерия угла СЬЮЗАН. Вместо оценки круглого диска учитываются только пиксели в окружности Брезенхема с радиусом  вокруг точки-кандидата. Если

вокруг точки-кандидата. Если  все дополнительные пиксели ярче ядра по крайней мере на

все дополнительные пиксели ярче ядра по крайней мере на  или все темнее ядра на

или все темнее ядра на  , то пиксель под ядром считается признаком. Сообщается, что этот тест дает очень стабильные функции. Выбор порядка, в котором проверяются пиксели, представляет собой так называемую задачу «Двадцать вопросов». Построение коротких решений для этой проблемы приводит к эффективным с точки зрения точки зрения доступным детекторам признаков.

, то пиксель под ядром считается признаком. Сообщается, что этот тест дает очень стабильные функции. Выбор порядка, в котором проверяются пиксели, представляет собой так называемую задачу «Двадцать вопросов». Построение коротких решений для этой проблемы приводит к эффективным с точки зрения точки зрения доступным детекторам признаков.

Первым методом обнаружения обнаруживает БЫСТРЫЙ, основанным на AST (признаки из ускоренного теста сегмента ).  в принципе может принимать любое значение, FAST использует только значение 3 (соответствует окружности 16 пикселей), и тесты показывают, что достигаются наилучшие результаты. где

в принципе может принимать любое значение, FAST использует только значение 3 (соответствует окружности 16 пикселей), и тесты показывают, что достигаются наилучшие результаты. где  равно 9. Это значение

равно 9. Это значение  является самым низким, при котором края не обнаруживаются. Порядок, в котором тестируются пиксели, определяется алгоритмом ID3 из обучающего изображений набора. Как ни странно, название детектора похоже на название статьи, описывающей детектор Трайковича и Хедли.

является самым низким, при котором края не обнаруживаются. Порядок, в котором тестируются пиксели, определяется алгоритмом ID3 из обучающего изображений набора. Как ни странно, название детектора похоже на название статьи, описывающей детектор Трайковича и Хедли.

Автоматический синтезатор детекторов

Трухильо и Олагу представили метод, с помощью которого генетическое программирование используется для автоматического выбора операторов изображений, которые могут обнаруживать точки интереса. Наборы терминалов и функций содержат примитивные операции, которые являются общими для многих ранее предложенных искусственных конструкций. Пригодность измеряет стабильность каждого оператора с распределением равномерности и равномерному распределению точек по плоскости изображения. Работоспособность усовершенствованных операторов была подтверждена экспериментально с помощью обучающих и тестовых последовательностей прогрессивно преобразованных изображений. Следовательно, предложенный алгоритм считается конкурентоспособным для человека в задаче обнаружения точки путиса.

Детекторы пространственно-временных точек интереса

Оператор Харриса был расширен на пространство-время Лаптевым и Линдебергом. Пусть  обозначает пространственно-временную матрицу второго момента, определенную как

обозначает пространственно-временную матрицу второго момента, определенную как

Затем, для подходящего выбора  пространственно-временные точки интереса обнаруживаются из пространственно-временных экстремумов пространственно-временной меры Харриса:

пространственно-временные точки интереса обнаруживаются из пространственно-временных экстремумов пространственно-временной меры Харриса:

Определитель оператора Гессе расширен на совместное пространство- времени Виллемса и др. и Линдеберга, что приводит к следующему нормированному по масштабу дифференциальному выражению:

В работе Виллемса и др. Более простое выражение, соответствующее  и

и  . В Lindeberg было показано, что

. В Lindeberg было показано, что  и

и  подразумевает лучшее sca Свойства выбора в том смысле, что выбранные масштабные уровни получены из пространственно -временного гауссова блоба с пространственным размером

подразумевает лучшее sca Свойства выбора в том смысле, что выбранные масштабные уровни получены из пространственно -временного гауссова блоба с пространственным размером  и временным размером

и временным размером  будет идеально соответствовать пространственной протяженности и временной продолжительности, с масштабным отслеживанием пространственно-временного масштабного пространства экстремумы дифференциального выражения.

будет идеально соответствовать пространственной протяженности и временной продолжительности, с масштабным отслеживанием пространственно-временного масштабного пространства экстремумы дифференциального выражения.

Оператор Лапласа был расширен Линдебергом на пространственно-временные видеоданные, что привело к следующим двум пространственно-временным операторам, которые также представили модели восприимчивых полей нейронов без задержки и нейронов в LGN:

Для первого оператора выбора масштаба требуется использование  и

и  , если мы хотим, чтобы этот оператор принимал максимальное значение по пространственно-временным масштабам на уровне пространственно-временного масштаба, отражающую пространственную протяженность и временную продолжительность начинающегося гауссова блоба. Для второго оператора выбора масштаба требуется использование

, если мы хотим, чтобы этот оператор принимал максимальное значение по пространственно-временным масштабам на уровне пространственно-временного масштаба, отражающую пространственную протяженность и временную продолжительность начинающегося гауссова блоба. Для второго оператора выбора масштаба требуется использование  и

и  , если мы хотим, чтобы этот оператор принимал максимальное значение по пространственно-временным масштабам на уровне пространственно-временного масштаба, отражающего пространственную протяженность и временную продолжительность мигающая гауссова капля.

, если мы хотим, чтобы этот оператор принимал максимальное значение по пространственно-временным масштабам на уровне пространственно-временного масштаба, отражающего пространственную протяженность и временную продолжительность мигающая гауссова капля.

Цветовые расширения детекторов пространственно-временных точек интереса исследованы Эвертсом и др.

Библиография

Эталонные реализации

В этом разделе приведены внешние ссылки на справочные реализации некоторых детекторов, описанных выше. Эти эталонные реализации предоставлены авторами статьи, в которой детектор впервые описывается. Они могут содержать детали, не представленные или явные в документах, описывающих функции.

- Обнаружение DoG (как часть системы SIFT ), Windows и x86 Linux исполняемые файлы

- Harris - Лаплас, статические исполняемые файлы Linux. Также содержит детекторы DoG и LoG и аффинную адаптацию для всех включенных детекторов.

- Детектор FAST, C, C ++, исходный код MATLAB и исполняемые файлы для различных систем и архитектур.

- lip-vireo, [LoG, DoG, Harris-Laplacian, Hessian и Hessian-Laplacian], [SIFT, инвариант SIFT, PCA-SIFT, PSIFT, управляемые фильтры, SPIN] [Linux, Windows и SunOS] исполняемые файлы.

- Низкоуровневая обработка изображений SUSAN, исходный код C.

- Онлайн-реализация детектора угла Харриса - IPOL

См. Также

Внешние ссылки

Результат типичного алгоритма обнаружения угла

Результат типичного алгоритма обнаружения угла

и

и  , затем этот пиксель

, затем этот пиксель  не имеет интересных особенностей.

не имеет интересных особенностей. и

и  имеет большое положительное значение, тогда обнаружено ребро.

имеет большое положительное значение, тогда обнаружено ребро. и

и

имеют большие положительные значения, тогда обнаруживается угол.

имеют большие положительные значения, тогда обнаруживается угол.

Определение углов с использованием алгоритма Ферстнера

Определение углов с использованием алгоритма Ферстнера

![\nabla I(\mathbf{x'})=[I_{\mathbf{x}},I_{\mathbf{y}}]^{\top}](https://wikimedia.org/api/rest_v1/media/math/render/svg/081d215e2f446da3883f43806705cbdb037db1b4)

можно рассматривать как остаток при вычислении решения методом наименьших квадратов: if

можно рассматривать как остаток при вычислении решения методом наименьших квадратов: if  , то ошибки не было.

, то ошибки не было.

.

.

![[1, 2]](https://wikimedia.org/api/rest_v1/media/math/render/svg/f2614991ef363710c34e03eb9110d7423e3f60c2)

:

:

,

, ,

,