В теории вероятностей, хотя простые примеры показывают, что линейная некоррелированность двух случайных величин, как правило, не подразумевает их независимость, иногда ошибочно полагают, что когда две случайные величины нормально распределены. Эта статья демонстрирует, что предположение о нормальном распределении не имеет таких последствий, хотя многомерное нормальное распределение , включая двумерное нормальное распределение, имеет.

Сказать, что пара  случайных величин имеет двумерное нормальное распределение, означает, что каждая линейная комбинация

случайных величин имеет двумерное нормальное распределение, означает, что каждая линейная комбинация  из

из  и

и  для постоянных (то есть не случайных) коэффициентов

для постоянных (то есть не случайных) коэффициентов  и

и  имеет одномерное нормальное распределение. В этом случае, если

имеет одномерное нормальное распределение. В этом случае, если  и

и  не коррелированы, то они независимы. Однако две случайные величины

не коррелированы, то они независимы. Однако две случайные величины  и

и  могут быть распределены вместе так, что каждая из них по отдельности незначительно нормально распределены, и они некоррелированы, но не независимы; примеры приведены ниже.

могут быть распределены вместе так, что каждая из них по отдельности незначительно нормально распределены, и они некоррелированы, но не независимы; примеры приведены ниже.

Содержание

- 1 Примеры

- 1.1 Симметричный пример

- 1.2 Асимметричный пример

- 1.3 Примеры с поддержкой почти везде в ℝ

- 2 См. Также

- 3 Ссылки

Примеры

Симметричный пример

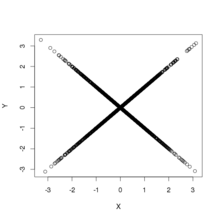

Объединенный диапазон

и

. Темнее означает более высокое значение функции плотности.

Предположим, что  имеет нормальное распределение с ожидаемым значением 0 и дисперсией 1. Пусть

имеет нормальное распределение с ожидаемым значением 0 и дисперсией 1. Пусть  имеют распределение Радемахера, так что

имеют распределение Радемахера, так что  или

или  , каждое с вероятностью 1/2, и предположим, что

, каждое с вероятностью 1/2, и предположим, что  не зависит от

не зависит от  . Пусть

. Пусть  . Тогда

. Тогда

и

и  не коррелированы;

не коррелированы;- оба имеют одинаковое нормальное распределение; и

и

и  не являются независимыми.

не являются независимыми.

Чтобы увидеть, что  и

и  не коррелированы, можно принять во внимание ковариацию

не коррелированы, можно принять во внимание ковариацию  : по определению это

: по определению это

Тогда по определению случайного переменные  ,

,  и

и  , а также независимость

, а также независимость  из

из  , один имеет

, один имеет

Чтобы увидеть, что  имеет то же нормальное распределение, что и

имеет то же нормальное распределение, что и  , рассмотрим

, рассмотрим

(поскольку  и

и  оба имеют одинаковое нормальное распределение), где

оба имеют одинаковое нормальное распределение), где  - это кумулятивная функция распределения нормального распределения.

- это кумулятивная функция распределения нормального распределения.

Чтобы увидеть, что  и

и  не являются независимыми, обратите внимание, что

не являются независимыми, обратите внимание, что  или что

или что  .

.

Наконец, распределение простой линейной комбинации  концентрирует положительную вероятность в 0:

концентрирует положительную вероятность в 0:  . Следовательно случайная величина

. Следовательно случайная величина  не имеет нормального распределения, а также

не имеет нормального распределения, а также  и

и  совместно не распределены нормально (по определению выше).

совместно не распределены нормально (по определению выше).

Пример асимметрии

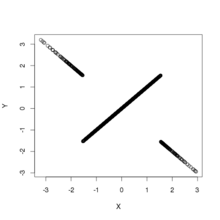

Совместная плотность

и

. Da rker указывает более высокое значение плотности.

Предположим, что  имеет нормальное распределение с ожидаемым значением 0 и дисперсией 1. Пусть

имеет нормальное распределение с ожидаемым значением 0 и дисперсией 1. Пусть

где  - положительное число, которое необходимо указать ниже.

- положительное число, которое необходимо указать ниже.  очень мало, тогда correlation

очень мало, тогда correlation  находится рядом с

находится рядом с  , если

, если  очень большой, то

очень большой, то  близко к 1. Поскольку корреляция является непрерывной функцией от

близко к 1. Поскольку корреляция является непрерывной функцией от  , теорема о промежуточном значении предполагает, что существует какое-то конкретное значение

, теорема о промежуточном значении предполагает, что существует какое-то конкретное значение  , которое делает корреляцию 0. Это значение примерно маты 1.54. В этом случае

, которое делает корреляцию 0. Это значение примерно маты 1.54. В этом случае  и

и  некоррелированы, но они явно не независимы, поскольку

некоррелированы, но они явно не независимы, поскольку  полностью определяет

полностью определяет  .

.

. Чтобы увидеть, что  нормально распределен - действительно, его распределение совпадает с распределением

нормально распределен - действительно, его распределение совпадает с распределением  - можно вычислить его кумулятивную функцию распределения :

- можно вычислить его кумулятивную функцию распределения :

где предпоследнее равенство следует из симметрии распределения  и симметрии условия, что

и симметрии условия, что  .

.

В этом примере разница  далека от нормального распределения, поскольку имеет существенное вероятность (около 0,88) того, что она равна 0. Напротив, нормальное распределение, будучи непрерывным распределением, не имеет дискретной части, то есть не концентрирует больше, чем нулевую вероятность в любой отдельной точке. Следовательно,

далека от нормального распределения, поскольку имеет существенное вероятность (около 0,88) того, что она равна 0. Напротив, нормальное распределение, будучи непрерывным распределением, не имеет дискретной части, то есть не концентрирует больше, чем нулевую вероятность в любой отдельной точке. Следовательно,  и

и  не являются совместно нормально распределенными, хотя они обычно распределены по отдельности.

не являются совместно нормально распределенными, хотя они обычно распределены по отдельности.

Примеры с поддержкой почти везде в ℝ

Хорошо известно, что соотношение  двух независимых стандартных нормальных случайных отклонений

двух независимых стандартных нормальных случайных отклонений  и

и  имеет распределение Коши. С таким же успехом можно начать со случайной величины Коши

имеет распределение Коши. С таким же успехом можно начать со случайной величины Коши  и получить условное распределение

и получить условное распределение  чтобы удовлетворить требованию, чтобы

чтобы удовлетворить требованию, чтобы  с

с  и

и  независимый и стандартный нормальный. Просчитывая математику, обнаруживаем, что

независимый и стандартный нормальный. Просчитывая математику, обнаруживаем, что

где  - случайная величина Радемахера, а

- случайная величина Радемахера, а  - Хи-квадрат случайная величина с двумя степенями свободы.

- Хи-квадрат случайная величина с двумя степенями свободы.

Рассмотрим два набора  ,

,  . Обратите внимание, что

. Обратите внимание, что  не индексируется

не индексируется  - то есть той же случайной величиной Коши

- то есть той же случайной величиной Коши  используется в определении как

используется в определении как  и

и  . Это совместное использование

. Это совместное использование  приводит к зависимостям между индексами: ни

приводит к зависимостям между индексами: ни  , ни

, ни  не зависит от

не зависит от  . Тем не менее, все

. Тем не менее, все  и

и  не коррелированы, поскольку все двумерные распределения имеют симметрию отражения по осям.

не коррелированы, поскольку все двумерные распределения имеют симметрию отражения по осям.

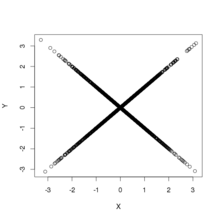

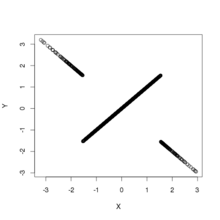

Ненормальные совместные распределения с нормальными краями.

На рисунке показаны диаграммы рассеяния выборок, взятых из вышеуказанного распределения. Это дает два примера двумерных распределений, которые некоррелированы и имеют нормальные предельные распределения, но не являются независимыми. На левой панели показано совместное распределение  и

и  ; дистрибутив поддерживается везде, но не у истоков. На правой панели показано совместное распределение

; дистрибутив поддерживается везде, но не у истоков. На правой панели показано совместное распределение  и

и  ; распределение имеет поддержку везде, кроме осей, и имеет разрыв в начале координат: плотность расходится при приближении к началу координат по любому прямому пути, кроме осей.

; распределение имеет поддержку везде, кроме осей, и имеет разрыв в начале координат: плотность расходится при приближении к началу координат по любому прямому пути, кроме осей.

См. Также

Ссылки

Объединенный диапазон

Объединенный диапазон  и

и  . Темнее означает более высокое значение функции плотности.

. Темнее означает более высокое значение функции плотности.

и

и  не коррелированы;

не коррелированы; и

и  не являются независимыми.

не являются независимыми.

.

Совместная плотность

Совместная плотность  и

и  . Da rker указывает более высокое значение плотности.

. Da rker указывает более высокое значение плотности.

Ненормальные совместные распределения с нормальными краями.

Ненормальные совместные распределения с нормальными краями.