В обработке сигналов фильтр Винера является фильтром используется для получения оценки желаемого или целевого случайного процесса посредством линейной не зависящей от времени (LTI ) фильтрации наблюдаемого зашумленного процесса, предполагая известные стационарные спектры сигнала и шума, а также аддитивные шум. Фильтр Винера минимизирует среднеквадратичную ошибку между оцененным случайным процессом и желаемым процессом.

Содержание

- 1 Описание

- 2 Решения с фильтром Винера

- 2.1 Непричинное решение

- 2.2 Причинное решение

- 3 Фильтр Винера с конечной импульсной характеристикой для дискретных серий

- 3.1 Связь с фильтром наименьших квадратов

- 3.2 Сложные сигналы

- 4 Приложения

- 5 История

- 6 См. Также

- 7 Ссылки

- 8 Внешние ссылки

Описание

Цель фильтра Винера - для вычисления статистической оценки неизвестного сигнала с использованием связанного сигнала в качестве входа и фильтрации этого известного сигнала для получения оценки в качестве выхода. Например, известный сигнал может состоять из интересующего неизвестного сигнала, который был искажен аддитивным шумом. Фильтр Винера может использоваться для фильтрации шума из искаженного сигнала, чтобы обеспечить оценку основного сигнала, представляющего интерес. Фильтр Винера основан на статистическом подходе, и более статистическое изложение теории дается в статье оценщика минимальной среднеквадратичной ошибки (MMSE).

Типичные детерминированные фильтры разработаны для желаемой частотной характеристики. Однако конструкция фильтра Винера использует другой подход. Предполагается, что кто-то знает спектральные свойства исходного сигнала и шума, а другой ищет линейный не зависящий от времени фильтр, выходной сигнал которого будет максимально приближен к исходному сигналу. Фильтры Винера характеризуются следующим:

- Допущение: сигнал и (аддитивный) шум являются стационарными линейными случайными процессами с известными спектральными характеристиками или известной автокорреляцией и взаимной корреляцией.

- Требование: фильтр должен быть физически реализуемым / причинным (это требование можно отбросить, что приведет к непричинному решению)

- Критерий эффективности: минимальный среднеквадратичный ошибка (MMSE)

Этот фильтр часто используется в процессе деконволюции ; для этого приложения см. деконволюция Винера.

Решения винеровского фильтра

Пусть  будет неизвестным сигналом, который должен оцениваться по сигналу измерения

будет неизвестным сигналом, который должен оцениваться по сигналу измерения  . Проблема фильтра Винера имеет решения для трех возможных случаев: первый, когда непричинный фильтр приемлем (требует бесконечного количества как прошлых, так и будущих данных), случай, когда желателен причинный фильтр (с использованием бесконечного количества прошлых данных), и случай конечной импульсной характеристики (FIR), когда используются только входные данные (т. е. результат или выход не передаются обратно в фильтр, как в случае IIR). Первый случай легко решить, но он не подходит для приложений реального времени. Основным достижением Винера было решение случая, в котором действует требование причинности; Норман Левинсон дал решение FIR в приложении к книге Винера.

. Проблема фильтра Винера имеет решения для трех возможных случаев: первый, когда непричинный фильтр приемлем (требует бесконечного количества как прошлых, так и будущих данных), случай, когда желателен причинный фильтр (с использованием бесконечного количества прошлых данных), и случай конечной импульсной характеристики (FIR), когда используются только входные данные (т. е. результат или выход не передаются обратно в фильтр, как в случае IIR). Первый случай легко решить, но он не подходит для приложений реального времени. Основным достижением Винера было решение случая, в котором действует требование причинности; Норман Левинсон дал решение FIR в приложении к книге Винера.

Непричинное решение

где  - спектральные плотности. При условии, что

- спектральные плотности. При условии, что  является оптимальным, тогда уравнение минимальной среднеквадратичной ошибки сводится к

является оптимальным, тогда уравнение минимальной среднеквадратичной ошибки сводится к

и решение  - обратное двустороннее преобразование Лапласа для

- обратное двустороннее преобразование Лапласа для  .

.

Причинное решение

где

состоит из причинной части

состоит из причинной части  (то есть эта часть этой дроби, имеющей положительное временное решение при обратном преобразовании Лапласа)

(то есть эта часть этой дроби, имеющей положительное временное решение при обратном преобразовании Лапласа) является причинным компонентом

является причинным компонентом  (т.е.., обратное преобразование Лапласа

(т.е.., обратное преобразование Лапласа  отлично от нуля только для

отлично от нуля только для  )

) - антипричинный компонент

- антипричинный компонент  (т.е. обратное преобразование Лапласа для

(т.е. обратное преобразование Лапласа для  не равно нулю только для

не равно нулю только для  )

)

Эта общая формула сложна и заслуживает более подробного объяснения. Чтобы записать решение  в конкретном случае, необходимо выполнить следующие шаги:

в конкретном случае, необходимо выполнить следующие шаги:

- Начать со спектра

в рациональной форме и разложите его на причинные и антипричинные компоненты:

в рациональной форме и разложите его на причинные и антипричинные компоненты:  где

где  содержит все нули и полюсы в левой полуплоскости (LHP), а

содержит все нули и полюсы в левой полуплоскости (LHP), а  содержит нули и полюсы в правой полуплоскости (RHP). Это называется факторизацией Винера – Хопфа.

содержит нули и полюсы в правой полуплоскости (RHP). Это называется факторизацией Винера – Хопфа. - Divide

на

на  и запишите результат в виде разложения частичной дроби.

и запишите результат в виде разложения частичной дроби. - Выберите в этом расширении только те термины, у которых есть полюсы в LHP. Назовите эти термины

.

. - Разделите

на

на  . Результатом является желаемая передаточная функция фильтра

. Результатом является желаемая передаточная функция фильтра  .

.

Фильтр Винера с конечной импульсной характеристикой для дискретных серий

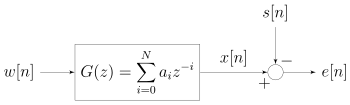

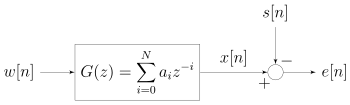

Блок-схема КИХ-фильтра Винера для дискретных серий. Входной сигнал w [n] свертывается с помощью фильтра Винера g [n], и результат сравнивается с опорным сигналом s [n] для получения ошибки фильтрации e [n].

Причинный конечный импульс response (FIR) Фильтр Винера вместо использования некоторой заданной матрицы данных X и выходного вектора Y находит оптимальные веса отводов, используя статистику входных и выходных сигналов. Он заполняет входную матрицу X оценками автокорреляции входного сигнала (T) и заполняет выходной вектор Y оценками взаимной корреляции между выходным и входным сигналами (V).

Чтобы вывести коэффициенты фильтра Винера, рассмотрим сигнал w [n], подаваемый на фильтр Винера порядка (количества прошедших отводов) N и с коэффициентами  . Выходной сигнал фильтра обозначается x [n], который задается выражением

. Выходной сигнал фильтра обозначается x [n], который задается выражением

![x [n] = \ sum _ {{i = 0}} ^ {N} a_ {i} w [ni].](https://wikimedia.org/api/rest_v1/media/math/render/svg/b52e807887e91ea452fcc1d5c0b8037593336d05)

Остаточная ошибка обозначается e [n] и определяется как e [n] = x [n] - s [n] (см. соответствующую блок-схему). Фильтр Винера разработан таким образом, чтобы минимизировать среднеквадратичную ошибку (критерии MMSE ), которую можно кратко сформулировать следующим образом:

![{\ displaystyle a_ {i} = \ arg \ min E \ left [e ^ {2} [n] \ right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c1479360ebceaf703b055388dcd8a3f1d251ca6)

где ![E [\ cdot]](https://wikimedia.org/api/rest_v1/media/math/render/svg/57d488a22bc9f41e976d3afb6036190bcbb36b2e) обозначает оператор ожидания. В общем случае коэффициенты

обозначает оператор ожидания. В общем случае коэффициенты  могут быть сложными и могут быть получены для случая, когда w [n] и s [n] также являются комплексными. При сложном сигнале решаемой матрицей является эрмитова матрица Теплица, а не симметричная матрица Теплица. Для простоты ниже рассматривается только случай, когда все эти величины действительны. Среднеквадратичная ошибка (MSE) может быть переписана как:

могут быть сложными и могут быть получены для случая, когда w [n] и s [n] также являются комплексными. При сложном сигнале решаемой матрицей является эрмитова матрица Теплица, а не симметричная матрица Теплица. Для простоты ниже рассматривается только случай, когда все эти величины действительны. Среднеквадратичная ошибка (MSE) может быть переписана как:

![{\ displaystyle {\ begin {align} E \ left [e ^ {2} [n] \ right] = E \ left [(x [n] -s [n]) ^ {2} \ right] \\ = E \ left [x ^ {2} [n] \ right] + E \ left [s ^ {2} [n] \ right] -2E [x [n] s [n]] \\ = E \ left [\ left (\ sum _ {i = 0} ^ {N} a_ {i} w [ni] \ right) ^ {2} \ right] + E \ left [s ^ {2} [n] \ right] -2E \ left [\ sum _ {i = 0 } ^ {N} a_ {i} w [ni] s [n] \ right] \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/93fade3732a89c3c06d14e7532d4e5ac8e8ba5e0)

Найти вектор ![[a_ {0}, \, \ ldots, \, a_ {N}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/23b15c3b4639ed827b254c60c133606cec814d33) , который минимизирует указанное выше выражение, вычислите его производную по каждому

, который минимизирует указанное выше выражение, вычислите его производную по каждому

![{\ displaystyle {\ begin {выровнено} {\ frac {\ partial} {\ partial a_ {i}}} E \ left [e ^ {2} [n] \ right] = {\ frac {\ partial} {\ partial a_ {i}}} \ left \ {E \ left [\ left (\ sum _ {i = 0} ^ {N} a_ {i} w [ni] \ right) ^ {2} \ right] + E \ left [s ^ {2} [n] \ right] -2E \ left [\ sum _ {i = 0} ^ {N } a_ {i} w [ni] s [n] \ right] \ right \} \\ = 2E \ left [\ left (\ sum _ {j = 0} ^ {N} a_ {j} w [nj ] \ right) w [ni] \ right] -2E [w [ni] s [n]] \\ = 2 \ left (\ sum _ {j = 0} ^ {N} E [w [nj] w [ni]] a_ {j} \ right) -2E [w [ni] s [n]] \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5d6d976673c02272293e722d361805d16cc612ee)

Предполагая, что каждый из w [n] и s [n] является стационарным и вместе стационарным, последовательности ![R_ {w} [m]](https://wikimedia.org/api/rest_v1/media/math/render/svg/6fd433a0ac1fe24b6b95d7bad92cea453be5c7f2) и

и ![{\ displaystyle R_ {ws} [m]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7e7790e74796ce594e25ef54c65a4af6ea895803) , известное соответственно как автокорреляция w [n] и взаимная корреляция между w [n] и s [n], могут быть определены следующим образом:

, известное соответственно как автокорреляция w [n] и взаимная корреляция между w [n] и s [n], могут быть определены следующим образом:

![{\ displaystyle {\ begin {align} R_ {w } [m] = E \ {w [n] w [n + m] \} \\ R_ {ws} [m] = E \ {w [n] s [n + m] \} \ end { выровнено}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/013fa6d6fbd4e75c4c4ffefdc98dde2ba69d0aeb)

Следовательно, производная MSE может быть переписана как:

![{\ displaystyle {\ frac {\ partial} {\ partial a_ {i} }} E \ left [e ^ {2} [n] \ right] = 2 \ left (\ sum _ {j = 0} ^ {N} R_ {w} [ji] a_ {j} \ right) -2R_ {ws} [i] \ qquad i = 0, \ cdots, N.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0b838dec6ea00072ce0d8b4ec7e69c4c24768811)

Обратите внимание, что для реального ![w [n]](https://wikimedia.org/api/rest_v1/media/math/render/svg/2a4e3e5afc2a8c6da9020b8c6b21450959101a18) , автокорреляция симметрична:

, автокорреляция симметрична:

![{\ displaystyle R_ {w} [ji] = R_ {w} [ij]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0a7c44b249eb0d5faa8fd08516814ecedbebc451)

Принятие производной равной нулю приводит к:

![{\ displaystyle \ sum _ {j = 0} ^ {N} R_ {w} [ji] a_ { j} = R_ {ws} [i] \ qquad i = 0, \ cdots, N.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2a9984c26d8ebeb301f22cbeeaa797ee44ef7632)

который можно переписать (используя указанное выше свойство симметрии) в матричной форме

![{\ displaystyle \ underbrace {\ begin {bmatrix} R_ {w} [0] R_ {w} [1] \ cdots R_ {w} [N] \\ R_ {w} [1] R_ {w} [0] \ cdots R_ {w} [N-1] \\\ vdots \ vdots \ ddots \ vdots \\ R_ {w} [N] R_ {w} [N-1] \ cdots R_ {w} [0] \ end {bmatrix}} _ {\ mathbf {T}} \ underbrace {\ begin {bmatrix} a_ {0} \\ a_ {1} \\\ vdots \\ a_ {N} \ end {bmatrix}} _ { \ mathbf {a}} = \ underbrace {\ begin {bmatrix} R_ {ws} [0] \\ R_ {ws} [1] \\\ vdots \\ R_ {ws} [N] \ end {bmatrix}} _ {\ mathbf {v}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/22ca4ea294dd47b8d634cb78e5be93073547626f)

Эти уравнения известны как уравнения Винера – Хопфа. Матрица T, встречающаяся в уравнении, является симметричной матрицей Теплица. При подходящих условиях на  эти матрицы, как известно, являются положительно определенными и, следовательно, неособыми, что дает уникальное решение для определения вектора коэффициентов фильтра Винера,

эти матрицы, как известно, являются положительно определенными и, следовательно, неособыми, что дает уникальное решение для определения вектора коэффициентов фильтра Винера,  . Кроме того, существует эффективный алгоритм для решения таких уравнений Винера – Хопфа, известный как алгоритм Левинсона-Дурбина, поэтому явное обращение T не требуется.

. Кроме того, существует эффективный алгоритм для решения таких уравнений Винера – Хопфа, известный как алгоритм Левинсона-Дурбина, поэтому явное обращение T не требуется.

В некоторых статьях функция взаимной корреляции определяется противоположным образом:

![{\ displaystyle R_ {sw} [m] = E \ {w [n] s [n + m] \}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/674ae192cf58157ffa143e5a78c60150f9e0ec96)

Тогда матрица

будет содержать

![{\ displaystyle R_ {sw } [0] \ ldots R_ {sw} [N]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c74f1a47c80f31bc0f228f14d5efc080ecfb440e)

; это просто разница в обозначениях.

Какое бы обозначение ни использовалось, обратите внимание, что для вещественного ![{\ displaystyle w [n], s [n]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/47e41c9959e941c5694db0af5c0634c4537c574c) :

:

![{\ displaystyle R_ {sw} [k] = R_ {ws} [- k]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/185aafdce950ee0f36925021ae3c93f5c5023d5b)

Отношение к фильтру наименьших квадратов

Реализация причинного фильтра Винера очень похожа на решение к оценке наименьших квадратов, за исключением области обработки сигналов. Решение методом наименьших квадратов для входной матрицы  и выходного вектора

и выходного вектора  равно

равно

КИХ-фильтр Винера связан с фильтром наименьших средних квадратов, но минимизация критерия ошибки последнего не зависит от взаимной корреляции или автокорреляции. Его решение сходится к решению фильтра Винера.

Сложные сигналы

Для сложных сигналов вывод комплексного винеровского фильтра выполняется путем минимизации ![{\ displaystyle E \ left [| e [n] | ^ {2} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ff9d46fcdf6b205655f7182df44cc92ec004ce5d) =

=![{\ displaystyle E \ left [e [n] e ^ {*} [n] \ справа]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/660e20966e374f35618b457d09451af5d0b1d7b1) . Это включает в себя вычисление частных производных как по действительной, так и по мнимой части

. Это включает в себя вычисление частных производных как по действительной, так и по мнимой части  и требование, чтобы они оба были равны нулю.

и требование, чтобы они оба были равны нулю.

Результирующие уравнения Винера-Хопфа:

![{\ displaystyle \ sum _ {j = 0} ^ {N} R_ {w} [ji] a_ {j} ^ { *} = R_ {ws} [i] \ qquad i = 0, \ cdots, N.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5a382076f2533f0688f1875d8f3a133be3d531f1)

, который можно переписать в матричном виде:

![{\ displaystyle \ underbrace {\ begin {bmatrix} R_ {w} [0] R_ {w} ^ {*} [1] \ cdots R_ {w } ^ {*} [N-1] R_ {w} ^ {*} [N] \\ R_ {w} [1] R_ {w} [0] \ cdots R_ {w} ^ {*} [N -2] R_ {w} ^ {*} [N-1] \\\ vdots \ vdots \ ddots \ vdots \ vdots \\ R_ {w} [N-1] R_ {w} [N- 2] \ cdots R_ {w} [0] R_ {w} ^ {*} [1] \\ R_ {w} [N] R_ {w} [N-1] \ cdots R_ {w} [1 ] R_ {w} [0] \ end {bmatrix}} _ {\ mathbf {T}} \ underbrace {\ begin {bmatrix} a_ {0} ^ {*} \\ a_ {1} ^ {*} \\ \ vdots \\ a_ {N-1} ^ {*} \\ a_ {N} ^ {*} \ end {bmatrix}} _ {\ mathbf {a ^ {*}}} = \ underbrace {\ begin {bmatrix } R_ {ws} [0] \\ R_ {ws} [1] \\\ vdots \\ R_ {ws} [N-1] \\ R_ {ws} [N] \ end {bmatrix}} _ {\ mathbf {v}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5189a3cd5eb8558934169b1ed63016fa0f5b14a7)

Обратите внимание, что:

![{\ displaystyle {\ begin {align} R_ {w} [- k] = R_ {w} ^ {*} [k] \\ R_ {sw} [k] = R_ {ws} ^ {*} [- k ] \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b747272d7edd8e56a4fa0ae17bc829245cefd5c2)

Затем вектор коэффициентов Винера вычисляется как:

Приложения

Фильтр Винера имеет множество применений в обработке сигналов, обработке изображений, системах управления и цифровой связи. Эти приложения обычно относятся к одной из четырех основных категорий:

Например, фильтр Винера может использоваться при обработке изображений для удаления шума из картина. Например, использование функции Mathematica: WienerFilter [image, 2]на первом изображении справа, создает отфильтрованное изображение под ним.

Шумное изображение космонавта.

Шумное изображение космонавта после применения фильтра Винера.

Обычно используется для подавления звуковых сигналов, особенно речи, в качестве препроцессора перед распознаванием речи.

История

Фильтр был предложен Норбертом Винером в 1940-х годах и опубликован в 1949 году. Дискретный эквивалент работы Винера был независимо выведен Андреем Колмогоровым и опубликован в 1941 году. Поэтому эту теорию часто называют теорией фильтрации Винера – Колмогорова (см. Кригинг ). Фильтр Винера был первым предложенным статистически разработанным фильтром, впоследствии породившим множество других, включая фильтр Калмана.

См. Также

Ссылки

- Томас Кайлат, Али Х. Сайед и Бабак Хассиби, Линейная оценка, Прентис-Холл, Нью-Джерси, 2000, ISBN 978-0-13-022464-4.

- Винер Н.: Интерполяция, экстраполяция и сглаживание стационарных временных рядов », Отчет Службы 19, Исследовательский проект DIC-6037 MIT, февраль 1942 г.

- Колмогоров АН: Стационарные последовательности в гильбертовом пространстве, Бюл. Московский унив. 1941 том 2 номер 6 1-40. Английский перевод в Kailath T. (ред.) Оценка линейных наименьших квадратов Dowden, Hutchinson Ross 1977

Внешние ссылки

- Mathematica WienerFilter function

состоит из причинной части

состоит из причинной части  (то есть эта часть этой дроби, имеющей положительное временное решение при обратном преобразовании Лапласа)

(то есть эта часть этой дроби, имеющей положительное временное решение при обратном преобразовании Лапласа) является причинным компонентом

является причинным компонентом  (т.е.., обратное преобразование Лапласа

(т.е.., обратное преобразование Лапласа  отлично от нуля только для

отлично от нуля только для  )

) - антипричинный компонент

- антипричинный компонент  (т.е. обратное преобразование Лапласа для

(т.е. обратное преобразование Лапласа для  не равно нулю только для

не равно нулю только для  )

)

в рациональной форме и разложите его на причинные и антипричинные компоненты:

в рациональной форме и разложите его на причинные и антипричинные компоненты:  где

где  содержит все нули и полюсы в левой полуплоскости (LHP), а

содержит все нули и полюсы в левой полуплоскости (LHP), а  содержит нули и полюсы в правой полуплоскости (RHP). Это называется факторизацией Винера – Хопфа.

содержит нули и полюсы в правой полуплоскости (RHP). Это называется факторизацией Винера – Хопфа. на

на  и запишите результат в виде разложения частичной дроби.

и запишите результат в виде разложения частичной дроби. .

. на

на  . Результатом является желаемая передаточная функция фильтра

. Результатом является желаемая передаточная функция фильтра  .

. Блок-схема КИХ-фильтра Винера для дискретных серий. Входной сигнал w [n] свертывается с помощью фильтра Винера g [n], и результат сравнивается с опорным сигналом s [n] для получения ошибки фильтрации e [n].

Блок-схема КИХ-фильтра Винера для дискретных серий. Входной сигнал w [n] свертывается с помощью фильтра Винера g [n], и результат сравнивается с опорным сигналом s [n] для получения ошибки фильтрации e [n].

![x [n] = \ sum _ {{i = 0}} ^ {N} a_ {i} w [ni].](https://wikimedia.org/api/rest_v1/media/math/render/svg/b52e807887e91ea452fcc1d5c0b8037593336d05)

![{\ displaystyle a_ {i} = \ arg \ min E \ left [e ^ {2} [n] \ right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c1479360ebceaf703b055388dcd8a3f1d251ca6)

![E [\ cdot]](https://wikimedia.org/api/rest_v1/media/math/render/svg/57d488a22bc9f41e976d3afb6036190bcbb36b2e)

![{\ displaystyle {\ begin {align} E \ left [e ^ {2} [n] \ right] = E \ left [(x [n] -s [n]) ^ {2} \ right] \\ = E \ left [x ^ {2} [n] \ right] + E \ left [s ^ {2} [n] \ right] -2E [x [n] s [n]] \\ = E \ left [\ left (\ sum _ {i = 0} ^ {N} a_ {i} w [ni] \ right) ^ {2} \ right] + E \ left [s ^ {2} [n] \ right] -2E \ left [\ sum _ {i = 0 } ^ {N} a_ {i} w [ni] s [n] \ right] \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/93fade3732a89c3c06d14e7532d4e5ac8e8ba5e0)

![[a_ {0}, \, \ ldots, \, a_ {N}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/23b15c3b4639ed827b254c60c133606cec814d33)

![{\ displaystyle {\ begin {выровнено} {\ frac {\ partial} {\ partial a_ {i}}} E \ left [e ^ {2} [n] \ right] = {\ frac {\ partial} {\ partial a_ {i}}} \ left \ {E \ left [\ left (\ sum _ {i = 0} ^ {N} a_ {i} w [ni] \ right) ^ {2} \ right] + E \ left [s ^ {2} [n] \ right] -2E \ left [\ sum _ {i = 0} ^ {N } a_ {i} w [ni] s [n] \ right] \ right \} \\ = 2E \ left [\ left (\ sum _ {j = 0} ^ {N} a_ {j} w [nj ] \ right) w [ni] \ right] -2E [w [ni] s [n]] \\ = 2 \ left (\ sum _ {j = 0} ^ {N} E [w [nj] w [ni]] a_ {j} \ right) -2E [w [ni] s [n]] \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5d6d976673c02272293e722d361805d16cc612ee)

![R_ {w} [m]](https://wikimedia.org/api/rest_v1/media/math/render/svg/6fd433a0ac1fe24b6b95d7bad92cea453be5c7f2)

![{\ displaystyle R_ {ws} [m]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7e7790e74796ce594e25ef54c65a4af6ea895803)

![{\ displaystyle {\ begin {align} R_ {w } [m] = E \ {w [n] w [n + m] \} \\ R_ {ws} [m] = E \ {w [n] s [n + m] \} \ end { выровнено}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/013fa6d6fbd4e75c4c4ffefdc98dde2ba69d0aeb)

![{\ displaystyle {\ frac {\ partial} {\ partial a_ {i} }} E \ left [e ^ {2} [n] \ right] = 2 \ left (\ sum _ {j = 0} ^ {N} R_ {w} [ji] a_ {j} \ right) -2R_ {ws} [i] \ qquad i = 0, \ cdots, N.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0b838dec6ea00072ce0d8b4ec7e69c4c24768811)

![w [n]](https://wikimedia.org/api/rest_v1/media/math/render/svg/2a4e3e5afc2a8c6da9020b8c6b21450959101a18)

![{\ displaystyle R_ {w} [ji] = R_ {w} [ij]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0a7c44b249eb0d5faa8fd08516814ecedbebc451) Принятие производной равной нулю приводит к:

Принятие производной равной нулю приводит к: ![{\ displaystyle \ sum _ {j = 0} ^ {N} R_ {w} [ji] a_ { j} = R_ {ws} [i] \ qquad i = 0, \ cdots, N.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2a9984c26d8ebeb301f22cbeeaa797ee44ef7632)

![{\ displaystyle \ underbrace {\ begin {bmatrix} R_ {w} [0] R_ {w} [1] \ cdots R_ {w} [N] \\ R_ {w} [1] R_ {w} [0] \ cdots R_ {w} [N-1] \\\ vdots \ vdots \ ddots \ vdots \\ R_ {w} [N] R_ {w} [N-1] \ cdots R_ {w} [0] \ end {bmatrix}} _ {\ mathbf {T}} \ underbrace {\ begin {bmatrix} a_ {0} \\ a_ {1} \\\ vdots \\ a_ {N} \ end {bmatrix}} _ { \ mathbf {a}} = \ underbrace {\ begin {bmatrix} R_ {ws} [0] \\ R_ {ws} [1] \\\ vdots \\ R_ {ws} [N] \ end {bmatrix}} _ {\ mathbf {v}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/22ca4ea294dd47b8d634cb78e5be93073547626f)

![{\ displaystyle R_ {sw} [m] = E \ {w [n] s [n + m] \}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/674ae192cf58157ffa143e5a78c60150f9e0ec96) Тогда матрица

Тогда матрица  будет содержать

будет содержать ![{\ displaystyle R_ {sw } [0] \ ldots R_ {sw} [N]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c74f1a47c80f31bc0f228f14d5efc080ecfb440e) ; это просто разница в обозначениях.

; это просто разница в обозначениях. ![{\ displaystyle w [n], s [n]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/47e41c9959e941c5694db0af5c0634c4537c574c)

![{\ displaystyle R_ {sw} [k] = R_ {ws} [- k]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/185aafdce950ee0f36925021ae3c93f5c5023d5b)

![{\ displaystyle E \ left [| e [n] | ^ {2} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ff9d46fcdf6b205655f7182df44cc92ec004ce5d)

![{\ displaystyle E \ left [e [n] e ^ {*} [n] \ справа]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/660e20966e374f35618b457d09451af5d0b1d7b1)

![{\ displaystyle \ sum _ {j = 0} ^ {N} R_ {w} [ji] a_ {j} ^ { *} = R_ {ws} [i] \ qquad i = 0, \ cdots, N.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5a382076f2533f0688f1875d8f3a133be3d531f1)

![{\ displaystyle \ underbrace {\ begin {bmatrix} R_ {w} [0] R_ {w} ^ {*} [1] \ cdots R_ {w } ^ {*} [N-1] R_ {w} ^ {*} [N] \\ R_ {w} [1] R_ {w} [0] \ cdots R_ {w} ^ {*} [N -2] R_ {w} ^ {*} [N-1] \\\ vdots \ vdots \ ddots \ vdots \ vdots \\ R_ {w} [N-1] R_ {w} [N- 2] \ cdots R_ {w} [0] R_ {w} ^ {*} [1] \\ R_ {w} [N] R_ {w} [N-1] \ cdots R_ {w} [1 ] R_ {w} [0] \ end {bmatrix}} _ {\ mathbf {T}} \ underbrace {\ begin {bmatrix} a_ {0} ^ {*} \\ a_ {1} ^ {*} \\ \ vdots \\ a_ {N-1} ^ {*} \\ a_ {N} ^ {*} \ end {bmatrix}} _ {\ mathbf {a ^ {*}}} = \ underbrace {\ begin {bmatrix } R_ {ws} [0] \\ R_ {ws} [1] \\\ vdots \\ R_ {ws} [N-1] \\ R_ {ws} [N] \ end {bmatrix}} _ {\ mathbf {v}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5189a3cd5eb8558934169b1ed63016fa0f5b14a7)

![{\ displaystyle {\ begin {align} R_ {w} [- k] = R_ {w} ^ {*} [k] \\ R_ {sw} [k] = R_ {ws} ^ {*} [- k ] \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b747272d7edd8e56a4fa0ae17bc829245cefd5c2)

Шумное изображение космонавта.

Шумное изображение космонавта.  Шумное изображение космонавта после применения фильтра Винера.

Шумное изображение космонавта после применения фильтра Винера.