LaMDA ( Language Model for Dialogue Applications) — семейство моделей диалогового нейронного языка, разработанное Google. О первом поколении было объявлено во время основного доклада Google I/O 2021 года, а о втором поколении было объявлено на мероприятии в следующем году. В июне 2022 года LaMDA привлекла к себе всеобщее внимание, когда инженер Google Блейк Лемуан заявил, что чат- бот стал разумным. Научное сообщество в значительной степени отвергло утверждения Лемуана, хотя это привело к разговорам об эффективности теста Тьюринга, который измеряет, может ли компьютер сойти за человека.

Google анонсировала модель разговорного нейронного языка LaMDA во время основного доклада Google I/O 18 мая 2021 года, основанного на искусственном интеллекте. Построенный на архитектуре нейронной сети Transformer, разработанной Google Research в 2017 году, LaMDA был обучен человеческому диалогу и историям, что позволяет ему участвовать в открытых беседах. Google заявляет, что ответы, генерируемые LaMDA, должны быть «осмысленными, интересными и специфичными для контекста».

11 мая 2022 года Google представила LaMDA 2, который является преемником LaMDA, во время основного доклада Google I/O 2022 года. Новая версия модели использует примеры текста из многочисленных источников, используя их для формулирования уникальных «естественных разговоров» на темы, на которые он, возможно, не был обучен отвечать. Кроме того, Google запустил AI Test Kitchen, мобильное приложение на базе LaMDA 2, способное по запросу предоставлять списки предложений на основе сложной цели. Первоначально открытое только для сотрудников Google, приложение будет доступно для «избранных ученых, исследователей и политиков» по приглашению где-то в этом году.

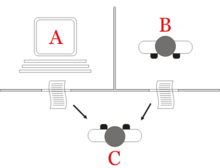

Утверждения Лемуана о том, что LaMDA может быть разумным, спровоцировали дискуссии о том, остается ли тест Тьюринга, изображенный выше, точным ориентиром в определении общего искусственного интеллекта.

Утверждения Лемуана о том, что LaMDA может быть разумным, спровоцировали дискуссии о том, остается ли тест Тьюринга, изображенный выше, точным ориентиром в определении общего искусственного интеллекта. 11 июня 2022 года The Washington Post сообщила, что инженер Google Блейк Лемуан был отправлен в оплачиваемый административный отпуск после того, как Лемуан сказал руководителям компании Блезу Агуера- и-Аркасу и Джен Дженнаи, что ЛаМДА стал разумным. Лемуан пришел к такому выводу после того, как чат-бот дал сомнительные ответы на вопросы, касающиеся самоидентификации, моральных ценностей, религии и Трех законов робототехники Айзека Азимова. Google опроверг эти утверждения, настаивая на том, что существуют существенные доказательства того, что LaMDA не обладает разумом. В интервью Wired Лемуан повторил свои утверждения о том, что LaMDA был «человеком» в соответствии с Тринадцатой поправкой, сравнив его с «инопланетным разумом земного происхождения». Он также сообщил, что Google уволил его после того, как он нанял адвоката от имени LaMDA после того, как чат-бот попросил Лемуана сделать это.

Заявления Лемуана были широко отвергнуты научным сообществом. Гэри Маркус, профессор психологии, ранее работавший в Нью-Йоркском университете, осудил их как «чушь на ходулях» и подчеркнул, что у ЛаМДА нет чувств или самосознания. Дэвид Пфау из дочерней компании Google DeepMind и Эрик Бриньолфссон из Института человеко-ориентированного искусственного интеллекта Стэнфордского университета высмеяли идею о том, что языковая модель может быть разумной. Янн ЛеКун, возглавляющий исследовательскую группу по искусственному интеллекту Meta Platforms, заявил, что нейронные сети, такие как LaMDA, «недостаточно мощны, чтобы достичь истинного интеллекта». Профессор Калифорнийского университета в Санта-Крузе Макс Креминский отметил, что архитектура LaMDA «не поддерживает некоторые ключевые возможности человеческого сознания» и что веса ее нейронной сети были «заморожены», предполагая, что это типичная модель большого языка, в то время как Университет Суррея профессор Адриан Хилтон объявил утверждение о том, что LaMDA обладает разумом, «смелым заявлением», не подкрепленным фактами. Ведущий разработчик IBM Watson Дэвид Ферруччи сравнил, как LaMDA выглядит как человек, точно так же, как это сделал Watson, когда он был впервые представлен. Бывший специалист по этике Google AI Тимнит Гебру назвал Лемуана жертвой «цикла шумихи», инициированного исследователями и СМИ. Утверждения Лемуана также вызвали дискуссию о том, остается ли тест Тьюринга полезным для определения прогресса исследователей в достижении искусственного общего интеллекта, при этом Уилл Омерус из The Post полагает, что тест действительно измерял, способны ли системы машинного интеллекта обманывать людей.

LaMDA использует языковую модель преобразователя только для декодера. Он предварительно обучен на текстовом корпусе, который включает как документы, так и диалоги, состоящие из 1,56 трлн слов, а затем обучен с помощью точной настройки данных, сгенерированных вручную аннотированными ответами, для осмысленности, интересности и безопасности. Тесты Google показали, что LaMDA превзошла человеческие ответы в области интереса. Модель преобразователя LaMDA и внешняя система поиска информации взаимодействуют для повышения точности фактов, предоставляемых пользователю.

Были протестированы три разные модели, самая большая из которых имела 137 миллиардов параметров без встраивания:

| Параметры | Слои | Единицы ( модель d) | Головы |

|---|---|---|---|

| 2Б | 10 | 2560 | 40 |

| 8Б | 16 | 4096 | 64 |

| 137Б | 64 | 8192 | 128 |

{{ cite journal }}:Цитировать журнал требует |journal=( помощь )