мера ковариации компонентов случайного вектора

A

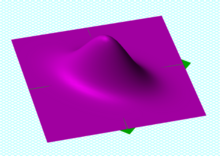

двумерная функция плотности вероятности Гаусса с центром в (0, 0), с ковариационной матрицей, заданной как

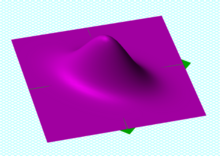

Выборочные точки из

двумерного гауссовского распределения со стандартным отклонением 3 примерно в нижнем левом и верхнем правом направлениях и 1 в ортогональном направлении. Компоненты X и Y меняются, дисперсии

и

не полностью описывают распределение.

необходима ковариационная матрица; собственное направление стрелок соответствуют

собственному моментм этой ковари квадратным корням, а их длина - величина из

собственных.

в теории вероятностей и статистике, матрица дисперсии, матрица дисперсии или дисперсия –Ковариационная матрица ) представляет собой квадратную матрицу , задающую ковариацию между каждым парой элементов данного случайного события. Любая ковариационная матрица является симметричной и положительно полуопределенной, а ее главная диагональ содержит дисперсии (то есть есть ковариацию каждого элемента с самим собой).

Интуитивно ковариационная матрица обобщает понятие дисперсии на несколько измерений. Например, изменение случайных точек в двумерном представлении может быть полностью охарактеризовано одним, как и отклонение в  и

и  содержат всю информацию; матрица

содержат всю информацию; матрица  необходима для полных характеристик двумерного изменения.

необходима для полных характеристик двумерного изменения.

Ковариационная матрица случайного вектора  обычно обозначается

обычно обозначается  или

или  .

.

Содержание

- 1 Определение

- 1.1 Обобщение дисперсии

- 1.2 Конфликтующие номенклатуры и обозначения

- 2 Свойства

- 2.1 Связь с матрицей автокорреляции

- 2.2 Связь с матрицей корреляции

- 2.3 Обратная матрица ковариации

- 2.4 Основные свойства

- 2.5 Блочные матрицы

- 3 Матрица частичной ковариации

- 4 Матрица ковариации как параметр распределения

- 5 Матрица ковари как линейный оператор

- 6 Какие матрицы являются ковариационными матрицами?

- 7 Комплексные случайные электрические

- 7.1 Матрица ковариации

- 7.2 Псевдоковариационная матрица

- 7.3 Свойства

- 8 Оценка

- 9 Приложения

- 9.1 Картирование ковариаций

- 9.2 Двумерная инфракрасная спектроскопия

- 10 См. Также

- 11 Ссылки

- 12 Далее ding

Определение

В этой статье полужирным шрифтом выделены  и

и  используются для обозначения случайных векторов, а нижние индексы с полужирным шрифтом

используются для обозначения случайных векторов, а нижние индексы с полужирным шрифтом  и

и  используются для обозначения скалярных случайных величин.

используются для обозначения скалярных случайных величин.

Если запись в векторе-столбце

- это случайные величины, каждая с конечной дисперсией и ожидаемое значение, тогда ковариационная матрица  - это матрица,

- это матрица,  запись - это ковариация

запись - это ковариация

![{\ displaystyle \ operatorname {K} _ {X_ {i} X_ {j}} = \ operatorname {cov} [X_ {i}, X_ {j}] = \ operatorname {E} [(X_ {i} - \ operatorname {E} [X_ {i}]) (X_ {j} - \ operatorname {E} [X_ {j}])]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/83bec85f5e2cab5d3406677dd806e554a442331f)

где оператор  обозначает ожидаемое значение (среднее) своего аргумента.

обозначает ожидаемое значение (среднее) своего аргумента.

Другими словами,

![{\ displaystyle \ operatorname {K} _ {\ mathbf {X} \ mathbf {X}} = {\ begin {bmatrix} \ mathrm {E} [(X_ {1} - \ operatorname {E} [X_ {1}]) (X_ {1} - \ operatorname {E} [X_ {1}])] \ mathrm {E} [( X_ {1} - \ operatorname {E} [X_ {1}]) (X_ {2} - \ operatorname {E} [X_ {2}])] \ cdots \ mathrm {E} [(X_ {1 } - \ operatorname {E} [X_ {1}]) (X_ {n} - \ operatorname {E} [X_ {n}])] \\\\\ mathrm {E} [(X_ {2} - \ имя оператора {E} [X_ {2}]) (X_ {1} - \ operatorname {E} [X_ {1}])] \ mathrm {E} [(X_ {2} - \ operatorname {E} [X_ {2}]) (X_ {2} - \ operatorname {E} [X_ {2}])] \ cdots \ mathrm {E} [(X_ {2} - \ operatorname {E} [X_ {2} ]) (X_ {n} - \ operatorname {E} [X_ {n}])] \\\\\ vdots \ vdots \ ddots \ vdots \\\\\ mathrm {E} [(X_ {n} - \ operatorname {E} [X_ {n}]) (X_ {1} - \ operatorname {E} [X_ {1}])] \ mathrm {E} [(X_ {n} - \ operatorname {E} [X_ {n}]) (X_ {2} - \ operatorname {E} [X_ {2}])] \ cdots \ mathrm {E} [(X_ {n} - \ operatorname {E} [X_ {n}]) (X_ {n} - \ operatorname {E} [X_ {n}])] \ конец {bmatrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/595ae6dc8ee7f0708dbf854a48a8c6bfad7ff8ce)

Приведенное выше определение эквивалентно матричному равенству

![{\ displaystyle \ operatorname {K} _ {\ mathbf {X} \ mathbf {X}} = \ operatorname {cov} [\ mathbf {X}, \ mathbf {X}] = \ operatorname { E} [(\ mathbf {X} - \ mathbf {\ mu _ {X}}) (\ mathbf {X} - \ mathbf {\ mu _ {X}}) ^ {\ rm {T}}] = \ имя оператора {E} [\ mathbf {X} \ mathbf {X} ^ {T}] - \ mathbf {\ му _ {X}} \ mathbf {\ му _ {X}} ^ {T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2dfbcd40b5e71238b0d3df4fd313ee4c8d5ce98a) | | (уравнение 1) |

где ![{\ displaystyle \ mathbf {\ mu _ {X}} = \ operatorname {E} [\ mathbf {X}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1d8bfb858b1c1ff6d479e0d41710e4e5be1966fa) .

.

Обобщение дисперсии

Эту формулу (уравнение 1 ) можно рассматривать как обобщение скалярной дисперсии на более высокие измерения. Помните, что для случайной величины со скалярным знаком

![{\ displaystyle \ sigma _ {X } ^ {2} = \ operatorname {var} (X) = \ operatorn ame {E} [(X- \ operatorname {E} [X]) ^ {2}] = \ operatorname {E} [(X- \ operatorname {E} [X]) \ cdot (X- \ operatorname {E } [X])].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d7298e1f1861406afedda8733e2950b94656c549)

На самом деле, элементы на диагонали автоковариационной матрицы  - дисперсии каждого элемента вектора

- дисперсии каждого элемента вектора  .

.

Противоречивые номенклатуры и обозначения

Номенклатуры различаются. Некоторые статистики, соответствующие вероятностным Уильямом Феллером в его двухтомной книге «Введение в теорию вероятностей и ее приложения», называют матрицу  дисперсия случайного события

дисперсия случайного события  , потому что это естественное обобщение однойерной дисперсии на более высокие измерения. Другие называют ее ковариационной матрицей, потому что это матрица ковариаций между скалярными компонентами вектора

, потому что это естественное обобщение однойерной дисперсии на более высокие измерения. Другие называют ее ковариационной матрицей, потому что это матрица ковариаций между скалярными компонентами вектора  .

.

![{\ displaystyle \ operatorname {var} (\ mathbf {X}) = \ operatorname {cov} (\ mathbf {X}) = \ operatorname {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}} \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cca6689e7e3aad726a5b60052bbd8f704f1b26bf)

Обе формы вполне стандартные, и между ими нет двусмысленности. Матрица  также часто называется матрицей ковариации и дисперсии, поскольку диагональные члены находятся в отклонении фактов.

также часто называется матрицей ковариации и дисперсии, поскольку диагональные члены находятся в отклонении фактов.

Для сравнения, обозначение для матрицы кросс-ковариации между двумя векторами:

![{\ displaystyle \ operatorname {cov} (\ mathbf {X}, \ mathbf {Y}) = \ operatorname {K } _ {\ mathbf {X} \ mathbf {Y}} = \ operatorname {E} \ le ft [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {Y} - \ operatorname {E} [\ mathbf {Y}]) ^ {\ rm {T}} \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1112b836c2cd9fde4ac076a44dfdbd213395a56b)

Свойства

Связь с матрицей автокорреляции

Матрица автоковариации  относится к матрице автокорреляции

относится к матрице автокорреляции  по

по

![{\ displaystyle \ operatorname {K } _ {\ mathbf {X} \ mathbf {X}} = \ operatorname {E} [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}}] = \ operatorname {R} _ {\ mathbf {X} \ mathbf {X}} - \ имя оператора { E} [\ mathbf {X}] \ имя оператора {E} [\ mathbf {X}] ^ {\ rm {T}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/00175de2c055b834a6f012910f7a5a3d1ed96353)

где автокорреляция ma trix означает ![{\ displaystyle \ operatorname {R} _ {\ mathbf {X} \ mathbf {X}} = \ operatorname { E} [\ mathbf {X} \ mathbf {X} ^ {\ rm {T}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/375369663d22bba80d770f6374289f95dd22cf63) .

.

Связь с корреляционной матрицей

Сущность, связанная с ковариационной матрицей, - это матрица коэффициентов корреляции произведения Пирсона между каждым из случайных величин в случайном векторе  , который можно записать как

, который можно записать как

где  - матрица диагональных элементов

- матрица диагональных элементов  (т. е. диагональная матрица из дисперсии

(т. е. диагональная матрица из дисперсии  для

для  ).

).

Эквивалентно корреляционную матрицу можно рассматривать как ковариационную матрицу стандартизованных случайных величин  для

для  .

.

![{\ displaystyle \ operatorname {corr} (\ mathbf {X}) = {\ begin {bmatrix } 1 {\ frac {\ operatorname {E} [(X_ {1} - \ mu _ {1}) (X_ {2} - \ mu _ {2})]} {\ sigma (X_ {1}) \ сигма (X_ {2})}} \ cdots {\ frac {\ operatorname {E} [(X_ {1} - \ mu _ {1}) (X_ {n} - \ mu _ {n})]} {\ sigma (X_ {1}) \ sigma (X_ {n})}} \\\\ { \ frac {\ operatorname {E} [(X_ {2} - \ mu _ {2}) (X_ {1} - \ mu _ {1})]} {\ sigma (X_ {2}) \ sigma (X_ {1})}} 1 \ cdots {\ frac {\ operatorname {E} [(X_ {2} - \ mu _ {2}) (X_ {n} - \ mu _ {n})]} {\ sigma (X_ {2}) \ sigma (X_ {n})}} \\\\\ vdots \ vdots \ ddots \ vdots \\\\ {\ frac {\ operatorname {E} [(X_ {n} - \ mu _ {n}) (X_ {1} - \ mu _ {1})]} {\ sigma (X_ {n}) \ sigma (X_ {1})}} и {\ frac { \ operatorname {E} [(X_ {n} - \ mu _ {n}) (X_ {2} - \ mu _ {2})]} {\ sigma (X_ {n}) \ sigma (X_ {2})}} \ cdots 1 \ end {bmatrix}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/df091a047aa8a9d829b25f68a5bbe6d56938b146)

Каждый элемент на главной диагонали корреляционной матрицы является корреляцией случайной величины с самим собой, которая вс е гда равна 1. Каждый недиагональный элемент находится между −1 и +1 включительно.

Обратная матрица ковариации

Обратная матрица  , если он существует, является обратной ковариационной матрицей, также известной как матрица концентрации или точность матрица.

, если он существует, является обратной ковариационной матрицей, также известной как матрица концентрации или точность матрица.

Основные свойства

Для ![{\ displaystyle \ operatorname {K} _ {\ mathbf { X} \ mathbf {X}} = \ operatorname {var} (\ mathbf {X}) = \ operatorname {E} \ left [\ left (\ mathbf {X} - \ operatorname {E} [\ mathbf {X} ] \ right) \ left (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}] \ right) ^ {\ rm {T}} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bed55fb51d1aad5b83b37076bdbd9ad0177a813b) и

и ![{\ displaystyle \ mathbf {\ mu _ {X}} = \ operatorname {E} [{\ textbf {X}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/25987aa171cbd6ec023a92eb06b6ee750de39309) , где

, где  a

a  -мерная случайн а я величина, применяемая ледующие:

-мерная случайн а я величина, применяемая ледующие:

является положительно-полуопределенным, т.е.

является положительно-полуопределенным, т.е.

является симметричным, т. е.

является симметричным, т. е.

- Для любых константы (т.е. неслучайно)

матрица

матрица  и константа

и константа  вектор

вектор  , один имеет

, один имеет

- Если

- другой случайный вектор с той же размерностью, что и

- другой случайный вектор с той же размерностью, что и  , тогда

, тогда  где

где  - матрица кросс-ковариаций из

- матрица кросс-ковариаций из  и

и  .

.

Блочные матрицы

Совместное среднее  и объединенная ковариационная матрица

и объединенная ковариационная матрица  из

из  и

и  можно записать в блочной форме

можно записать в блочной форме

где  ,

,  и

и  .

.

и

и  можно идентифицировать как матрицы дисперсии предельных распределений для

можно идентифицировать как матрицы дисперсии предельных распределений для  и

и  соответственно.

соответственно.

Если  и

и  равны совместно нормально распределенные,

равны совместно нормально распределенные,

условное распределение для  с учетом

с учетом  задается как

задается как

имеет условным средним

и условная дисперсия

Матрица  известна как матрица коэффициентов регрессии, а в линейная алгебра

известна как матрица коэффициентов регрессии, а в линейная алгебра  - это дополнение Шура для

- это дополнение Шура для  в

в  .

.

Матрица коэффициентов регрессии часто может быть представлена в транспонированной форме,  , подходит для постмножения вектор-строка независимых переменных

, подходит для постмножения вектор-строка независимых переменных  вместо предварительного умножения вектора-столбца

вместо предварительного умножения вектора-столбца  . В этой они соответствуют коэффициентам, полученным путем преобразования матрицы нормальных видов из обыкновенных наименьших квадратов (OLS).

. В этой они соответствуют коэффициентам, полученным путем преобразования матрицы нормальных видов из обыкновенных наименьших квадратов (OLS).

Матрица частичной ковариации

Матрица ковариации со всеми ненулевыми элементами сообщает нам, что все отдельные случайные величины взаимосвязаны. Это означает, что переменные не связаны через другие переменные. Часто такие косвенные синфазные корреляции тривиальны и неинтересны. Их можно подавить, вычислить частичную матрицу ковариаций, то есть часть матрицы ковариаций, которая показывает только интересную часть корреляций.

Если два случаяных величин  и

и  коррели через другой вектор

коррели через другой вектор  , последние корреляции подавляются в матрице

, последние корреляции подавляются в матрице

Матрица частичной ковариации  фактически представляет собой простую ковариационную матрицу

фактически представляет собой простую ковариационную матрицу  как если бы неинтересные случайные величины

как если бы неинтересные случайные величины  оставались постоянными.

оставались постоянными.

Ковариационная матрица как параметр распределения

Если вектор-столбец  of

of  возможно коррелированные случайные величины совместно нормально распределенные или, в более общем смысле, эллиптически распределенные, тогда его функция плотности вероятности

возможно коррелированные случайные величины совместно нормально распределенные или, в более общем смысле, эллиптически распределенные, тогда его функция плотности вероятности  можно выразить через ковариационную матрицу

можно выразить через ковариационную матрицу  следующим образом

следующим образом

где ![{\ displaystyle \ mathbf {\ mu = \ имя оператора {E} [X]}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d9c821aa85a1cbc2edfffb9343c51c7cd3541b34) и

и  - это определитель из

- это определитель из  .

.

Ковариационная матрица как линейная оператор

Применительно к одному вектору ковариационная матрица отображает линейную комбинацию c случайных величин X на вектор ковариаций с этими переменными:  . Рассматриваемый как билинейная форма, он дает ковариацию между двумя линейными комбинациями:

. Рассматриваемый как билинейная форма, он дает ковариацию между двумя линейными комбинациями:  . Тогда дисперсия линейной комбинации равна

. Тогда дисперсия линейной комбинации равна  , ее ковариация с самим собой.

, ее ковариация с самим собой.

Точно так же (псевдо) обратная ковариационная матрица обеспечивает внутренний продукт  , что индуцирует расстояние Махаланобиса, меру «маловероятность» c.

, что индуцирует расстояние Махаланобиса, меру «маловероятность» c.

Какие матрицы являются ковариационными матрицами?

Из тождества чуть выше, пусть  будет a

будет a  вектор с действительными значениями, тогда

вектор с действительными значениями, тогда

который всегда должен быть неотрицательным, так как это дисперсия действительной случайной величины. Ковариационная матрица всегда является положительно-полуопределенной матрицей, поскольку

![{\ displaystyle {\ begin {align} w ^ {\ rm {T}} \ имя оператора {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}} \ right] w = \ ope ratorname {E} \ left [w ^ {\ rm {T}} (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}} w \ right] \\ [5pt] = {} \ operatorname {E} {\ big [} {\ big (} w ^ {\ rm {T} } (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) {\ big)} ^ {2} {\ big]} \ geq 0 \ quad {\ text {Since}} w ^ { \ rm {T}} (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) {\ text {является скаляром}}. \ end {выравнивается}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f3473dcc676ecd0d74db28a005f6656a957c33c4)

И наоборот, каждая симметричная положительно полуопределенная матрица является ковариационной матрицей. Чтобы убедиться в этом предположим, что  является

является  положительно-полуопределенной матрицей. Из конечного случая спектральной теоремы следует, что

положительно-полуопределенной матрицей. Из конечного случая спектральной теоремы следует, что  имеет неотрицательный симметричный квадратный корень, который может обозначается M . Пусть

имеет неотрицательный симметричный квадратный корень, который может обозначается M . Пусть  будет любой

будет любой  случайной величиной с векторным знаком-столбцом, ковариация которой матрица - это единичная матрица

случайной величиной с векторным знаком-столбцом, ковариация которой матрица - это единичная матрица  . Тогда

. Тогда

Комплексные случайные ожиданые условия

Матрица ковариации

дисперсия комплексной случайной величиной со скалярным знаком с размером  обычно определяется с помощью комплексного сопряжения :

обычно определяется с помощью комплексного сопряжения :

![{\ displaystyle \ operatorname {var} (Z) = \ operatorname {E} \ left [(Z- \ mu _ {Z}) {\ overline {(Z- \ mu _ { Z})}} \ right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b3a3d7abfa56fdb689ebd3c01388715ad4773d4a)

где комплексное сопряжение комплексного числа  обозначается

обозначается  ; таким образом, дисперсия сложной случайной величины является действительным числом.

; таким образом, дисперсия сложной случайной величины является действительным числом.

Если  - вектор-столбец комплексных случайных величин, тогда сопряженное транспонирование формируется как транспонирование, так и сопряжением. В следующем изображении приложения на сопряженное транспонирование приводит к квадратной матрице, называемой ковариационной матрицей, как ее ожидание:

- вектор-столбец комплексных случайных величин, тогда сопряженное транспонирование формируется как транспонирование, так и сопряжением. В следующем изображении приложения на сопряженное транспонирование приводит к квадратной матрице, называемой ковариационной матрицей, как ее ожидание:

![{\ displaystyle \ operatorname {K} _ {\ mathbf {Z} \ mathbf {Z}} = \ operatorname {cov} [\ mathbf {Z}, \ mathbf {Z}] = \ operatorname {E} \ left [(\ mathbf {Z} - \ mathbf {\ mu _ {Z}}) (\ mathbf {Z} - \ mathbf {\ mu _ {Z}}) ^ {\ mathrm {H}} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/88c60e556c5e5f705d6448f79339174ec62b1ffd) ,

,

где  обозначает сопряженное транспонирование, это применимо к скаляру, поскольку транспонированный скаляр по-прежнему скаляром. Полученная таким образом матрица будет эрмитовой положительно-полуопределенной с действительными числами на главной диагонали и комплексными числами вне диагонали.

обозначает сопряженное транспонирование, это применимо к скаляру, поскольку транспонированный скаляр по-прежнему скаляром. Полученная таким образом матрица будет эрмитовой положительно-полуопределенной с действительными числами на главной диагонали и комплексными числами вне диагонали.

Матрица псевдоковариации

Для сложных случайных векторов, другого типа второго момента центрального, матрица псевдоковариации (также называемая матрицей отношений) определяется следующим образом. В отличие от ковариационной матрицы, указанная выше, эрмитова транспозиция заменяется транспонированием в определение.

![{\ displaystyle \ имя оператора {J} _ {\ mathbf {Z} \ mathbf {Z}} = \ operatorname {cov} [\ mathbf {Z}, {\ overline { \ mathbf {Z}}}] = \ operatorname {E} \ left [(\ mathbf {Z} - \ mathbf {\ mu _ {Z}}) (\ mathbf {Z} - \ mathbf {\ mu _ {Z }}) ^ {\ mathrm {T}} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bba62bd04d95107abdaa72eb5b505496ad4151ea)

Свойства

- Ковариационная матрица является эрмитовой матрица, то есть

.

. - Диагональные элементы ковариационной матрицы действительны.

Оценка

Если  и

и  центрированные матрицы данных размерности

центрированные матрицы данных размерности  и

и  соответственно, т.е. с n столбцами наблюдения p и q столбцов, из которых строки означают, что были вычтены, то, если средние по строкам были оценены на основе данных, выборочные ковариационные матрицы

соответственно, т.е. с n столбцами наблюдения p и q столбцов, из которых строки означают, что были вычтены, то, если средние по строкам были оценены на основе данных, выборочные ковариационные матрицы  и

и  можно определить как

можно определить как

или, если средние строки были известны априори,

Эти эмпирические выборочные ковариационные матрицы наиболее простыми и часто используемыми оценками для ковариационных матриц, но и другие оценки также существуют, включая регуляризованные средства оценки или оценки усадки, которые имеют лучшие свойства.

Приложения

Ковариационная матрица - полезный инструмент во многих областях. Из него может быть получена матрица преобразования , называемая преобразованием отбеливания, которая позволяет полностью декоррелировать данные или с другой точки зрения, найти оптимальную основу для представления данные в компактном виде (см. фактор Рэлея для формального доказательства и свойств ковариационных матриц). Это называется анализом главных компонентов (PCA) и преобразованием Карунена - Лоэва (KL-преобразованием).

Ковариационная матрица играет ключевую роль в финансовой, особенно в теории портфелей и ее теореме разделения паевых инвестиционных фондов и в модель ценообразования основных средств. Матрица ковариаций доходности различных инструментов определения, определенных предположительных, относительных различных активов, которые используются (в нормативном анализе ) или прогнозируются (в положительном анализе ) для сохранения в контексте диверсификации.

Ковариационное отображение

В ковариационном отображении значения  или

или  строятся как двумерная карта. Когда ориентируется

строятся как двумерная карта. Когда ориентируется  и

и  крупными случайными функциями, карта показывает статистические отношения между различными областями случайных функций. Статистически независимые области функций отображаются на карте как равнины с нулевым уровнем, а положительные или отрицательные корреляции отображаются, соответственно, как холмы или долины.

крупными случайными функциями, карта показывает статистические отношения между различными областями случайных функций. Статистически независимые области функций отображаются на карте как равнины с нулевым уровнем, а положительные или отрицательные корреляции отображаются, соответственно, как холмы или долины.

На практике векторы столбцов  и

и  получены экспериментально как строки из

получены экспериментально как строки из  образцов, например

образцов, например

![{\ displaystyle [\ mathbf {X} _ {1}, \ mathbf {X} _ {2},... \ mathbf {X} _ {n}] = {\ begin {bmatrix } X_ {1} (t_ {1}) X_ {2} (t_ {1}) \ cdots X_ {n} (t_ {1}) \\\\ X_ {1} (t_ {2}) X_ {2} (t_ {2}) \ cdots X_ {n} (t_ {2}) \\\\\ vdots \ vdots \ ddots \ vdots \\\\ X_ {1} (t_ {m}) X_ {2} (t_ {m}) \ cdots X_ {n} (t_ {m}) \ end {bmatrix}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/be824f93648e01daa17bd4e9d99b4398026b0149)

где  - i-е дискретное значение в выборке j случайной функции

- i-е дискретное значение в выборке j случайной функции  . Ожидаемые значения, необходимые в формуле ковариации, оцениваются с использованием выборочного среднего , например

. Ожидаемые значения, необходимые в формуле ковариации, оцениваются с использованием выборочного среднего , например

, а ковариационная матрица оценивается с помощью выборочной ковариации матрицы

где угловые скобки обозначают усреднение выборки, как и раньше, за исключением того, что поправка Бесселя должна быть сделана, чтобы избежать смещение. Используя эту оценку, матрица частичной ковариации может быть вычислена как

где обратная косая черта обозначает оператор деления левой матрицы, который обходит требование инвертировать матрицу и доступен в некоторые вычислительные пакеты, такие как Matlab.

Рис. 1: Построение частичной ковариационной карты N 2 молекул, подвергающихся кулоновскому взрыву, вызванному лазером на свободных электронах. Панели a и b отображают два члена ковариационной матрицы, которая показана на панели c . Панель d отображает синфазные корреляции через флуктуации интенсивности лазера. Панель e отображает частичную ковариационную матрицу, скорректированную с учетом флуктуаций интенсивности. Панель f показывает, что 10% избыточная коррекция улучшает карту и делает ионно-ионные корреляции четко видимыми. Благодаря импульсу Эти корреляции выглядят как линии, приблизительно перпендикулярные линии автокорреляции (и периодическим модуляциям, вызываемым звоном детектора).

Рис. 1 показано, как строится частичная ковариационная карта на примере эксперимента, проведенного на FLASH лазере на свободных электронах в Гамбурге. Случайная функция  - это времяпролетный спектр ионов от кулоновского взрыва молекул азота многократно ионизируются лазерным импульсом. Поскольку за каждый лазерный импульс ионизируются всего несколько сотен молекул, однократные спектры сильно колеблются. Однако обычно собирая

- это времяпролетный спектр ионов от кулоновского взрыва молекул азота многократно ионизируются лазерным импульсом. Поскольку за каждый лазерный импульс ионизируются всего несколько сотен молекул, однократные спектры сильно колеблются. Однако обычно собирая  таких спектров,

таких спектров,  , и их усреднение по

, и их усреднение по  дает гладкий спектр

дает гладкий спектр  , который показан красным внизу рис. 1. Средний спектр

, который показан красным внизу рис. 1. Средний спектр  показывает несколько ионов азота в виде пиков, уширенных их кинетической энергией, но для нахождения корреляций между стадиями ионизации и импульсами ионов требуется вычислить ковариационную карту.

показывает несколько ионов азота в виде пиков, уширенных их кинетической энергией, но для нахождения корреляций между стадиями ионизации и импульсами ионов требуется вычислить ковариационную карту.

В примере на рис. 1 спектры  и

и  те же самые, за исключением того, что диапазон времени пролета

те же самые, за исключением того, что диапазон времени пролета  отличается. Панель a показывает

отличается. Панель a показывает  , панель b показывает

, панель b показывает  и панель c показывает их различие, которое составляет

и панель c показывает их различие, которое составляет  (обратите внимание на изменение цветовой гаммы). К сожалению, эта карта перегружена неинтересными синфазными корреляциями, вызванными колебаниями интенсивности лазера от кадра к кадру. Чтобы подавить такие корреляции, интенсивность лазера

(обратите внимание на изменение цветовой гаммы). К сожалению, эта карта перегружена неинтересными синфазными корреляциями, вызванными колебаниями интенсивности лазера от кадра к кадру. Чтобы подавить такие корреляции, интенсивность лазера  записывается при каждом выстреле, помещается в

записывается при каждом выстреле, помещается в  и

и  вычисляется как панели d и e показывают. Однако подавление неинтересных корреляций несовершенно, поскольку существуют источники синфазных флуктуаций, и в принципе все эти источники должны управляться в векторе

вычисляется как панели d и e показывают. Однако подавление неинтересных корреляций несовершенно, поскольку существуют источники синфазных флуктуаций, и в принципе все эти источники должны управляться в векторе  . Однако на практике часто бывает достаточно сверхкомпенсировать частичную ковариационную поправку, как показано на панели f, где теперь отчетливо видны корреляции импульсов в виде прямых линий с центром на стадиях ионизации атомарного азота.

. Однако на практике часто бывает достаточно сверхкомпенсировать частичную ковариационную поправку, как показано на панели f, где теперь отчетливо видны корреляции импульсов в виде прямых линий с центром на стадиях ионизации атомарного азота.

Двумерная инфракрасная спектроскопия

Двумерная инфракрасная спектроскопия использует корреляционный анализ для получения 2D-спектров конденсированной фазы. Существует две версии этого анализа: синхронный и асинхронный. Математически первая выражается в терминах выборочной ковариационной матрицы, метод эквивалентен ковариационному отображению.

См.

Ссылки

Дополнительная литература

A двумерная функция плотности вероятности Гаусса с центром в (0, 0), с ковариационной матрицей, заданной как

A двумерная функция плотности вероятности Гаусса с центром в (0, 0), с ковариационной матрицей, заданной как

Выборочные точки из двумерного гауссовского распределения со стандартным отклонением 3 примерно в нижнем левом и верхнем правом направлениях и 1 в ортогональном направлении. Компоненты X и Y меняются, дисперсии

Выборочные точки из двумерного гауссовского распределения со стандартным отклонением 3 примерно в нижнем левом и верхнем правом направлениях и 1 в ортогональном направлении. Компоненты X и Y меняются, дисперсии  и

и  не полностью описывают распределение.

не полностью описывают распределение.  необходима ковариационная матрица; собственное направление стрелок соответствуют собственному моментм этой ковари квадратным корням, а их длина - величина из собственных.

необходима ковариационная матрица; собственное направление стрелок соответствуют собственному моментм этой ковари квадратным корням, а их длина - величина из собственных.

![{\ displaystyle \ operatorname {K} _ {X_ {i} X_ {j}} = \ operatorname {cov} [X_ {i}, X_ {j}] = \ operatorname {E} [(X_ {i} - \ operatorname {E} [X_ {i}]) (X_ {j} - \ operatorname {E} [X_ {j}])]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/83bec85f5e2cab5d3406677dd806e554a442331f)

![{\ displaystyle \ operatorname {K} _ {\ mathbf {X} \ mathbf {X}} = {\ begin {bmatrix} \ mathrm {E} [(X_ {1} - \ operatorname {E} [X_ {1}]) (X_ {1} - \ operatorname {E} [X_ {1}])] \ mathrm {E} [( X_ {1} - \ operatorname {E} [X_ {1}]) (X_ {2} - \ operatorname {E} [X_ {2}])] \ cdots \ mathrm {E} [(X_ {1 } - \ operatorname {E} [X_ {1}]) (X_ {n} - \ operatorname {E} [X_ {n}])] \\\\\ mathrm {E} [(X_ {2} - \ имя оператора {E} [X_ {2}]) (X_ {1} - \ operatorname {E} [X_ {1}])] \ mathrm {E} [(X_ {2} - \ operatorname {E} [X_ {2}]) (X_ {2} - \ operatorname {E} [X_ {2}])] \ cdots \ mathrm {E} [(X_ {2} - \ operatorname {E} [X_ {2} ]) (X_ {n} - \ operatorname {E} [X_ {n}])] \\\\\ vdots \ vdots \ ddots \ vdots \\\\\ mathrm {E} [(X_ {n} - \ operatorname {E} [X_ {n}]) (X_ {1} - \ operatorname {E} [X_ {1}])] \ mathrm {E} [(X_ {n} - \ operatorname {E} [X_ {n}]) (X_ {2} - \ operatorname {E} [X_ {2}])] \ cdots \ mathrm {E} [(X_ {n} - \ operatorname {E} [X_ {n}]) (X_ {n} - \ operatorname {E} [X_ {n}])] \ конец {bmatrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/595ae6dc8ee7f0708dbf854a48a8c6bfad7ff8ce)

![{\ displaystyle \ operatorname {K} _ {\ mathbf {X} \ mathbf {X}} = \ operatorname {cov} [\ mathbf {X}, \ mathbf {X}] = \ operatorname { E} [(\ mathbf {X} - \ mathbf {\ mu _ {X}}) (\ mathbf {X} - \ mathbf {\ mu _ {X}}) ^ {\ rm {T}}] = \ имя оператора {E} [\ mathbf {X} \ mathbf {X} ^ {T}] - \ mathbf {\ му _ {X}} \ mathbf {\ му _ {X}} ^ {T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2dfbcd40b5e71238b0d3df4fd313ee4c8d5ce98a)

![{\ displaystyle \ mathbf {\ mu _ {X}} = \ operatorname {E} [\ mathbf {X}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1d8bfb858b1c1ff6d479e0d41710e4e5be1966fa)

![{\ displaystyle \ sigma _ {X } ^ {2} = \ operatorname {var} (X) = \ operatorn ame {E} [(X- \ operatorname {E} [X]) ^ {2}] = \ operatorname {E} [(X- \ operatorname {E} [X]) \ cdot (X- \ operatorname {E } [X])].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d7298e1f1861406afedda8733e2950b94656c549)

![{\ displaystyle \ operatorname {var} (\ mathbf {X}) = \ operatorname {cov} (\ mathbf {X}) = \ operatorname {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}} \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cca6689e7e3aad726a5b60052bbd8f704f1b26bf)

![{\ displaystyle \ operatorname {cov} (\ mathbf {X}, \ mathbf {Y}) = \ operatorname {K } _ {\ mathbf {X} \ mathbf {Y}} = \ operatorname {E} \ le ft [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {Y} - \ operatorname {E} [\ mathbf {Y}]) ^ {\ rm {T}} \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1112b836c2cd9fde4ac076a44dfdbd213395a56b)

![{\ displaystyle \ operatorname {K } _ {\ mathbf {X} \ mathbf {X}} = \ operatorname {E} [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}}] = \ operatorname {R} _ {\ mathbf {X} \ mathbf {X}} - \ имя оператора { E} [\ mathbf {X}] \ имя оператора {E} [\ mathbf {X}] ^ {\ rm {T}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/00175de2c055b834a6f012910f7a5a3d1ed96353)

![{\ displaystyle \ operatorname {R} _ {\ mathbf {X} \ mathbf {X}} = \ operatorname { E} [\ mathbf {X} \ mathbf {X} ^ {\ rm {T}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/375369663d22bba80d770f6374289f95dd22cf63)

![{\ displaystyle \ operatorname {corr} (\ mathbf {X}) = {\ begin {bmatrix } 1 {\ frac {\ operatorname {E} [(X_ {1} - \ mu _ {1}) (X_ {2} - \ mu _ {2})]} {\ sigma (X_ {1}) \ сигма (X_ {2})}} \ cdots {\ frac {\ operatorname {E} [(X_ {1} - \ mu _ {1}) (X_ {n} - \ mu _ {n})]} {\ sigma (X_ {1}) \ sigma (X_ {n})}} \\\\ { \ frac {\ operatorname {E} [(X_ {2} - \ mu _ {2}) (X_ {1} - \ mu _ {1})]} {\ sigma (X_ {2}) \ sigma (X_ {1})}} 1 \ cdots {\ frac {\ operatorname {E} [(X_ {2} - \ mu _ {2}) (X_ {n} - \ mu _ {n})]} {\ sigma (X_ {2}) \ sigma (X_ {n})}} \\\\\ vdots \ vdots \ ddots \ vdots \\\\ {\ frac {\ operatorname {E} [(X_ {n} - \ mu _ {n}) (X_ {1} - \ mu _ {1})]} {\ sigma (X_ {n}) \ sigma (X_ {1})}} и {\ frac { \ operatorname {E} [(X_ {n} - \ mu _ {n}) (X_ {2} - \ mu _ {2})]} {\ sigma (X_ {n}) \ sigma (X_ {2})}} \ cdots 1 \ end {bmatrix}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/df091a047aa8a9d829b25f68a5bbe6d56938b146)

![{\ displaystyle \ operatorname {K} _ {\ mathbf { X} \ mathbf {X}} = \ operatorname {var} (\ mathbf {X}) = \ operatorname {E} \ left [\ left (\ mathbf {X} - \ operatorname {E} [\ mathbf {X} ] \ right) \ left (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}] \ right) ^ {\ rm {T}} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bed55fb51d1aad5b83b37076bdbd9ad0177a813b)

![{\ displaystyle \ mathbf {\ mu _ {X}} = \ operatorname {E} [{\ textbf {X}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/25987aa171cbd6ec023a92eb06b6ee750de39309)

является положительно-полуопределенным, т.е.

является положительно-полуопределенным, т.е.

является симметричным, т. е.

является симметричным, т. е.

матрица

матрица  и константа

и константа  вектор

вектор  , один имеет

, один имеет

- другой случайный вектор с той же размерностью, что и

- другой случайный вектор с той же размерностью, что и  , тогда

, тогда  где

где  - матрица кросс-ковариаций из

- матрица кросс-ковариаций из  и

и  .

.

![{\ displaystyle \ mathbf {\ mu = \ имя оператора {E} [X]}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d9c821aa85a1cbc2edfffb9343c51c7cd3541b34)

![{\ displaystyle {\ begin {align} w ^ {\ rm {T}} \ имя оператора {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}} \ right] w = \ ope ratorname {E} \ left [w ^ {\ rm {T}} (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ rm {T}} w \ right] \\ [5pt] = {} \ operatorname {E} {\ big [} {\ big (} w ^ {\ rm {T} } (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) {\ big)} ^ {2} {\ big]} \ geq 0 \ quad {\ text {Since}} w ^ { \ rm {T}} (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) {\ text {является скаляром}}. \ end {выравнивается}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f3473dcc676ecd0d74db28a005f6656a957c33c4)

![{\ displaystyle \ operatorname {var} (Z) = \ operatorname {E} \ left [(Z- \ mu _ {Z}) {\ overline {(Z- \ mu _ { Z})}} \ right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b3a3d7abfa56fdb689ebd3c01388715ad4773d4a)

![{\ displaystyle \ operatorname {K} _ {\ mathbf {Z} \ mathbf {Z}} = \ operatorname {cov} [\ mathbf {Z}, \ mathbf {Z}] = \ operatorname {E} \ left [(\ mathbf {Z} - \ mathbf {\ mu _ {Z}}) (\ mathbf {Z} - \ mathbf {\ mu _ {Z}}) ^ {\ mathrm {H}} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/88c60e556c5e5f705d6448f79339174ec62b1ffd) ,

,

![{\ displaystyle \ имя оператора {J} _ {\ mathbf {Z} \ mathbf {Z}} = \ operatorname {cov} [\ mathbf {Z}, {\ overline { \ mathbf {Z}}}] = \ operatorname {E} \ left [(\ mathbf {Z} - \ mathbf {\ mu _ {Z}}) (\ mathbf {Z} - \ mathbf {\ mu _ {Z }}) ^ {\ mathrm {T}} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bba62bd04d95107abdaa72eb5b505496ad4151ea)

.

.

![{\ displaystyle [\ mathbf {X} _ {1}, \ mathbf {X} _ {2},... \ mathbf {X} _ {n}] = {\ begin {bmatrix } X_ {1} (t_ {1}) X_ {2} (t_ {1}) \ cdots X_ {n} (t_ {1}) \\\\ X_ {1} (t_ {2}) X_ {2} (t_ {2}) \ cdots X_ {n} (t_ {2}) \\\\\ vdots \ vdots \ ddots \ vdots \\\\ X_ {1} (t_ {m}) X_ {2} (t_ {m}) \ cdots X_ {n} (t_ {m}) \ end {bmatrix}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/be824f93648e01daa17bd4e9d99b4398026b0149)

Рис. 1: Построение частичной ковариационной карты N 2 молекул, подвергающихся кулоновскому взрыву, вызванному лазером на свободных электронах. Панели a и b отображают два члена ковариационной матрицы, которая показана на панели c . Панель d отображает синфазные корреляции через флуктуации интенсивности лазера. Панель e отображает частичную ковариационную матрицу, скорректированную с учетом флуктуаций интенсивности. Панель f показывает, что 10% избыточная коррекция улучшает карту и делает ионно-ионные корреляции четко видимыми. Благодаря импульсу Эти корреляции выглядят как линии, приблизительно перпендикулярные линии автокорреляции (и периодическим модуляциям, вызываемым звоном детектора).

Рис. 1: Построение частичной ковариационной карты N 2 молекул, подвергающихся кулоновскому взрыву, вызванному лазером на свободных электронах. Панели a и b отображают два члена ковариационной матрицы, которая показана на панели c . Панель d отображает синфазные корреляции через флуктуации интенсивности лазера. Панель e отображает частичную ковариационную матрицу, скорректированную с учетом флуктуаций интенсивности. Панель f показывает, что 10% избыточная коррекция улучшает карту и делает ионно-ионные корреляции четко видимыми. Благодаря импульсу Эти корреляции выглядят как линии, приблизительно перпендикулярные линии автокорреляции (и периодическим модуляциям, вызываемым звоном детектора).